Lokalne wdrożenie LLM do dokumentów: bezpieczeństwo, pełna kontrola i zgodność AI

W różnych branżach, od finansów i sektora prawnego po ochronę zdrowia i produkcję, organizacje są pod wrażeniem możliwości dużych modeli językowych (LLM). Modele te potrafią czytać, rozumieć i analizować dokumenty z inteligencją zbliżoną do ludzkiej, wyodrębniając kluczowe dane, klasyfikując treści, podsumowując złożone raporty, a nawet identyfikując niespójności lub ryzyka w rozległych zbiorach danych.

Jednak, choć rozwiązania AI oparte na chmurze są imponujące, największą przeszkodą pozostaje bezpieczeństwo. Większość przedsiębiorstw nie może sobie pozwolić na ryzyko przesyłania poufnych umów, faktur, dokumentów kadrowych czy plików związanych z zgodnością do zewnętrznej usługi chmurowej. Przesyłanie wrażliwych lub regulowanych danych naraża organizacje na wyciek informacji, naruszenia prywatności oraz złamanie wymogów zgodności.

Poza kwestią bezpieczeństwa pojawia się również problem praktyczności. Ciągłe przesyłanie terabajtów dokumentów do chmurowego LLM jest nieefektywne, kosztowne i często uniemożliwia analizę w czasie rzeczywistym. Prawdziwie inteligentny system do pracy z dokumentami musi działać nieprzerwanie w tym samym kontrolowanym środowisku, w którym przechowywane są dane, z bezpośrednim dostępem do wszystkich powiązanych plików i baz danych. Przesyłanie losowych, odizolowanych plików do zdalnego silnika AI nie zapewni kompleksowej analizy uwzględniającej kontekst.

Dlatego coraz więcej przedsiębiorstw decyduje się na lokalne wdrożenie LLM. Uruchomienie modelu w środowisku on-premise lub w prywatnej chmurze pozwala organizacji bezpiecznie przechowywać wszystkie dokumenty we własnej infrastrukturze, a jednocześnie zapewnia AI pełny, kontrolowany dostęp do głębokiej analizy, wyszukiwania, ekstrakcji i rozumienia treści.

Lokalne wdrożenie LLM łączy w sobie to, co najlepsze z obu światów:

- Inteligencję oraz potencjał automatyzacji AI,

- Ochronę danych, nadzór oraz zgodność, których wymagają przedsiębiorstwa.

W niniejszym artykule omawiamy, jak wdrożyć LLM lokalnie do przetwarzania dokumentów, przedstawiamy kluczowe zasady bezpieczeństwa oraz praktyczne kroki, które czynią to podejście bezpieczną drogą do wykorzystania AI.

⚙️ Dlaczego lokalne LLM do dokumentów?

Obecnie niemal każda organizacja chce wykorzystać potencjał generatywnej AI, czyli zdolność do czytania, rozumienia i analizowania dokumentów na dużą skalę. Jednak większość przedsiębiorstw napotyka tę samą barierę: bezpieczeństwo i ryzyko ujawnienia danych. Przekazywanie poufnych umów, faktur, dokumentów kadrowych czy akt prawnych do zewnętrznego, chmurowego LLM wiąże się z poważnym zagrożeniem. Wrażliwe informacje mogą zostać ujawnione, niewłaściwie przetworzone lub wyjść poza ramy regulacyjne. W branżach objętych rygorystycznymi wymogami zgodności, takich jak finanse, administracja publiczna, ochrona zdrowia czy prawo, jest to po prostu niedopuszczalne.

Wdrożenie LLM lokalnie, zarówno w środowisku on-premise, jak i w prywatnej chmurze (VPC), eliminuje te ryzyka i zapewnia organizacjom niezbędną kontrolę.

Oto w jaki sposób lokalne wdrożenie wypełnia lukę między innowacyjnością AI a bezpieczeństwem klasy enterprise:

🔒 Twoje dokumenty nigdy nie opuszczają Twojej infrastruktury

Wszystkie dane pozostają w zabezpieczonym środowisku organizacji. LLM działa w obrębie Twojej sieci, zapewniając, że żaden dokument ani metadane nie są przekazywane na zewnątrz.

🧭 Pełna kontrola nad dostępem, rejestrowaniem i zgodnością

Integracja z istniejącymi systemami tożsamości (SSO, Active Directory itp.), możliwość stosowania szczegółowych uprawnień opartych na rolach oraz utrzymywanie pełnych ścieżek audytu każdej interakcji użytkownika. Każde zapytanie i każdy dostęp do dokumentu są rejestrowane i możliwe do prześledzenia.

⚙️ AI dopasowana do Twoich danych i procesów

Lokalne wdrożenie umożliwia dostrojenie i adaptację LLM do typów dokumentów, formatów oraz procesów biznesowych w Twojej organizacji. Możesz personalizować prompty, wzorce ekstrakcji i przepływy pracy tak, aby precyzyjnie odpowiadały Twoim operacjom, czego uniwersalny model publiczny nie jest w stanie zapewnić.

🧩 Bezproblemowa integracja z systemami wewnętrznymi

Ponieważ model działa w ramach Twojej infrastruktury, może bezpośrednio uzyskiwać dostęp do połączonych systemów, takich jak ERP, CRM czy współdzielone dyski. Umożliwia to bardziej kompleksową i kontekstową analizę, w której LLM rozumie zależności między wieloma dokumentami w czasie rzeczywistym.

💡 Spójna, bezpieczna i zawsze dostępna AI

W przeciwieństwie do publicznych API zależnych od zewnętrznej łączności lokalny LLM działa nieprzerwanie w obrębie Twojej sieci. Może natychmiast przetwarzać dokumenty, nawet w środowiskach odizolowanych lub typu air gap, zapewniając pełną niezależność operacyjną.

🧱 Architektura wysokiego poziomu: LLM za zaporą sieciową

W elDoc wierzymy, że prawdziwa transformacja AI musi iść w parze z bezpieczeństwem danych, kontrolą i zgodnością z regulacjami. Dlatego nasza architektura została zaprojektowana w oparciu o prostą, lecz niezwykle skuteczną zasadę:

Przenieś inteligencję do swoich danych, a nie dane do inteligencji.

Niezależnie od tego, czy wdrożenie odbywa się na zabezpieczonym serwerze, w prywatnej chmurze czy nawet na lokalnej stacji roboczej, architektura elDoc gwarantuje, że dokumenty nigdy nie opuszczają Twojego środowiska, a LLM działa bezpiecznie za zaporą sieciową. Nawet mniejsze, zoptymalizowane modele LLM mogą działać bezpośrednio na wydajnym laptopie lub komputerze stacjonarnym, umożliwiając przetwarzanie i analizę dokumentów offline lub w sieciach o ograniczonym dostępie. W przypadku obciążeń na skalę enterprise ta sama architektura może być płynnie skalowana w klastrach GPU lub w prywatnych środowiskach VPC przy zachowaniu identycznych zasad ochrony danych.

Architektura zbudowana wokół elDoc została zaprojektowana tak, aby zapewnić bezpieczeństwo, skalowalność oraz pełną gotowość LLM do inteligentnego przetwarzania dokumentów. W jej centrum elDoc koordynuje w pełni zintegrowane środowisko, w którym MongoDB, baza wektorowa oraz lokalnie wdrożony LLM współpracują ze sobą, zapewniając analizę dokumentów w czasie rzeczywistym, automatyzację procesów oraz zgodność regulacyjną, a wszystko to bezpiecznie w obrębie Twojej infrastruktury. Dzięki centralnej roli elDoc każda warstwa architektury, od przechowywania danych po wnioskowanie AI, jest zoptymalizowana pod kątem prywatności, wydajności i interoperacyjności. MongoDB zapewnia wysokowydajne przechowywanie dokumentów i metadanych; baza wektorowa umożliwia wyszukiwanie semantyczne oraz mechanizmy Retrieval-Augmented Generation (RAG); natomiast lokalny LLM odpowiada za zaawansowane rozumienie dokumentów, klasyfikację i powiązania między nimi bez ujawniania danych systemom zewnętrznym.

Rezultatem jest samowystarczalny ekosystem AI klasy enterprise, który chroni prywatność Twoich danych, a jednocześnie wzmacnia zespoły inteligencją generatywnej AI, wszystko w zaufanym, zgodnym z regulacjami i w pełni kontrolowanym środowisku elDoc.

Jak architektura elDoc bezpiecznie dostarcza inteligencję LLM do Twoich dokumentów

📥 1. Import i normalizacja dokumentów

Proces rozpoczyna się od przechwycenia, oczyszczenia i przygotowania danych dokumentowych. W elDoc możesz przesyłać i przetwarzać praktycznie każdy typ pliku, od wysoce ustrukturyzowanych formularzy po całkowicie nieustrukturyzowane dokumenty tekstowe, wszystko w ramach jednolitego i inteligentnego pipeline’u.

Obsługiwane typy dokumentów:

- 📄 Dokumenty ustrukturyzowane: wyciągi bankowe, faktury, rachunki za media, paragony, zamówienia zakupu, arkusze kalkulacyjne.

- 🧾 Dokumenty półustrukturyzowane: raporty, wnioski, formularze wewnętrzne.

- 📚 Dokumenty nieustrukturyzowane: umowy, polityki, wytyczne, procedury, cenniki oraz korespondencja.

- 🖼️ Obrazy i skany: zdjęcia lub zeskanowane kopie dokumentów w dowolnym formacie.

Etapy przetwarzania:

- 🧠 Wstępne przetwarzanie z wykorzystaniem computer vision – elDoc stosuje inteligentną korektę obrazu w celu normalizacji skanów przed procesem OCR. Obejmuje to usuwanie artefaktów obrazu, regulację jasności, korektę obrotu i przekrzywienia oraz eliminację szumów tła, aby zapewnić optymalne rozpoznawanie tekstu.

- 🔤 Optical Character Recognition (OCR) – rozpoznaje i konwertuje drukowany lub odręczny tekst do postaci czytelnej dla systemu, zapewniając, że każdy dokument, nawet zeskanowany lub sfotografowany, staje się w pełni przeszukiwalny i gotowy do analizy.

- 🧩 Ekstrakcja tekstu i analiza struktury układu – elDoc inteligentnie identyfikuje sekcje dokumentu, tabele oraz akapity, zachowując kontekst i relacje wizualne dla precyzyjnego rozumienia treści.

- 🗂️ Parsowanie danych i przechwytywanie metadanych – wyodrębnia istotne punkty danych, takie jak daty, dostawcy, typy dokumentów, identyfikatory faktur, numery referencyjne oraz inne atrybuty specyficzne dla biznesu.

Cel:

Przekształcenie chaotycznych dokumentów w różnych formatach w czysty, ustrukturyzowany i czytelny maszynowo tekst, w pełni przygotowany do zaawansowanego wnioskowania AI, klasyfikacji i analizy.

📌 Przykład: Prześlij zeskanowaną fakturę lub obszerną umowę, a elDoc automatycznie poprawi jakość obrazu, wykona OCR, wyodrębni kluczowe pola oraz znormalizuje treść, umożliwiając natychmiastowe wyszukiwanie, indeksowanie i inteligentną analizę.

🗄️ 2. Przechowywanie dokumentów oparte na MongoDB

Po przetworzeniu wszystkie dane dokumentowe, zarówno ustrukturyzowane, jak i nieustrukturyzowane, są bezpiecznie przechowywane w lokalnej infrastrukturze z wykorzystaniem MongoDB, co zapewnia idealną równowagę między wydajnością, elastycznością i ochroną. MongoDB pełni rolę centralnego filaru danych w elDoc, będąc wysokowydajną bazą danych o elastycznym schemacie, która bez trudu dostosowuje się do różnorodnych formatów dokumentów i struktur metadanych.

Dlaczego MongoDB?

- 🧩 Elastyczny projekt schematu: architektura oparta na dokumentach w MongoDB doskonale obsługuje zmienne i ewoluujące struktury dokumentów, od faktur i umów po korespondencję, formularze i raporty, bez konieczności stosowania sztywnych szablonów.

- ⚡ Wysoka wydajność i dostęp w czasie rzeczywistym: zoptymalizowana pod kątem szybkiego wykonywania zapytań, umożliwia natychmiastowe pobieranie dokumentów i metadanych na potrzeby wyszukiwania, walidacji oraz procesów AI, nawet przy dużym obciążeniu klasy enterprise.

- 🔐 Bezpieczeństwo klasy enterprise: wbudowane szyfrowanie danych w spoczynku, zabezpieczenia na poziomie pól oraz ochrona TLS zapewniają poufność informacji. MongoDB bezproblemowo integruje się z istniejącymi systemami IAM i SSO, utrzymując spójną politykę kontroli dostępu.

- 🧱 Skalowalność i niezawodność: rozproszona, skalowalna horyzontalnie architektura umożliwia organizacjom efektywne przetwarzanie milionów dokumentów, co jest kluczowe przy inteligentnym przetwarzaniu na dużą skalę.

Kontrola dostępu i zarządzanie danymi:

LLM nigdy nie komunikuje się bezpośrednio z surową bazą danych. Zamiast tego elDoc zarządza komunikacją za pośrednictwem bezpiecznych, audytowanych interfejsów API, które egzekwują zasady modelu zero trust, zapewniając, że tylko autoryzowane procesy mogą odpytywać lub modyfikować dane. Każde zdarzenie dostępu jest rejestrowane i możliwe do prześledzenia, co zapewnia pełną przejrzystość dla zespołów ds. zgodności i audytu.

📌 Rezultat:

Wszystkie Twoje dokumenty pozostają zaszyfrowane, ustrukturyzowane i natychmiast dostępne dla procesów opartych na AI, niezależnie od tego, czy chodzi o wyszukiwanie, ekstrakcję czy analizę, bez opuszczania zabezpieczonego środowiska. MongoDB zapewnia, że elDoc łączy szybkość innowacji z pewnością ochrony danych na poziomie klasy enterprise.

🔍 3. Indeksowanie i baza wektorowa (warstwa RAG)

Aby umożliwić rzeczywiście inteligentne i kontekstowe rozumienie dokumentów, elDoc integruje wydajną bazę wektorową jako część swojej architektury rdzeniowej. Komponent ten stanowi fundament podejścia Retrieval-Augmented Generation (RAG), czyli modelu hybrydowego łączącego wyszukiwanie semantyczne z wnioskowaniem LLM, co zapewnia, że każda odpowiedź generowana przez AI jest precyzyjna, wyjaśnialna i oparta na danych Twojej organizacji.

🧩 Jak to działa

Po przetworzeniu i normalizacji dokumentów elDoc przeprowadza indeksowanie semantyczne, przekształcając nieustrukturyzowany tekst w znaczące reprezentacje danych.

- Dzielenie na segmenty kontekstowe

Każdy dokument jest inteligentnie dzielony na mniejsze, bogate w kontekst segmenty, takie jak akapity, klauzule czy wiersze tabel. Pozwala to zachować logiczny układ dokumentu, a jednocześnie umożliwia bardziej precyzyjne wyszukiwanie i pobieranie informacji. - Generowanie embeddingów

Dla każdego segmentu elDoc generuje wektor numeryczny, zwany embeddingiem, który odzwierciedla semantyczne znaczenie tekstu, a nie jedynie jego słowa kluczowe. Oznacza to, że system rozumie, iż „termination clause” i „contract cancellation terms” odnoszą się do tego samego pojęcia, nawet jeśli zostały sformułowane w inny sposób. - Wzbogacanie metadanych

Każdy embedding jest przechowywany wraz z odpowiednimi metadanymi, takimi jak typ dokumentu, dział, data, dostawca, wartość umowy czy kategoria, co umożliwia wielowymiarowe filtrowanie oraz kontekstowe pobieranie informacji. - Przechowywanie w bazie wektorowej

Embeddingi są bezpiecznie przechowywane w bazie wektorowej, w pełni zintegrowanej z mechanizmami kontroli dostępu elDoc oraz zapleczem MongoDB. Baza jest zoptymalizowana pod kątem wyszukiwania podobieństwa semantycznego, co umożliwia zapytania w czasie rzeczywistym wśród milionów zindeksowanych fragmentów dokumentów.

🧠 Cel i funkcjonalność

Taka architektura pozwala LLM uzyskiwać dostęp wyłącznie do najbardziej istotnych, wiarygodnych i aktualnych informacji podczas generowania odpowiedzi lub przeprowadzania analizy. Zamiast „zgadywać” na podstawie ogólnego treningu, LLM korzysta z prywatnej bazy wiedzy wektorowej, zapewniając, że każdy wniosek opiera się na zweryfikowanych dokumentach Twojej organizacji.

Gdy użytkownik przesyła zapytanie, na przykład:

„Pokaż wszystkie umowy z dostawcami zawierające klauzule odnowienia dłuższe niż jeden rok,”

elDoc przeprowadza wyszukiwanie semantyczne wśród embeddingów wektorowych. Identyfikuje odpowiednie fragmenty dokumentów, nawet jeśli tekst nie zawiera dokładnie tych samych sformułowań, wybiera najlepsze dopasowania i przekazuje je do LLM jako kontekst do wygenerowania odpowiedzi.

Dzięki temu każda odpowiedź jest:

- 📚 Trafna kontekstowo — oparta na zweryfikowanych źródłach wewnętrznych, a nie na ogólnych danych z internetu.

- 🔒 Bezpieczna — przetwarzana w całości w obrębie Twojej infrastruktury, bez wywołań zewnętrznych API.

- ⚙️ Identyfikowalna — każdą odpowiedź LLM można powiązać z pierwotnym fragmentem dokumentu, co wspiera procesy audytu i walidacji.

⚡ Kluczowe korzyści

- Zrozumienie semantyczne: wykracza poza wyszukiwanie słów kluczowych, rozpoznając znaczenie, relacje i intencje w dokumentach.

- Inteligencja międzydokumentowa: umożliwia elDoc analizowanie i korelowanie informacji w tysiącach plików, na przykład łączenie faktur z umowami czy identyfikowanie brakujących dokumentów zgodności.

- Skalowalność: baza wektorowa efektywnie obsługuje miliony embeddingów, umożliwiając odpowiedzi w czasie rzeczywistym nawet w rozbudowanych środowiskach dokumentowych klasy enterprise.

- Zgodność i audytowalność: każda operacja wyszukiwania i pobierania jest rejestrowana, co zapewnia pełną przejrzystość i rozliczalność.

Dzięki bazie wektorowej elDoc opartej na mechanizmie RAG Twoja AI nie przeszukuje już internetu, lecz wiedzę Twojej organizacji. Każda odpowiedź jest bogata w kontekst, poufna i w pełni zgodna z regulacjami, co pozwala ufać wynikom AI w takim samym stopniu jak własnej dokumentacji.

🧠 4. Środowisko uruchomieniowe lokalnego LLM – Twoje prywatne silnik AI

W centrum architektury elDoc znajduje się środowisko uruchomieniowe lokalnego LLM, czyli inteligentny silnik odpowiadający za rozumienie, wnioskowanie i automatyzację w całym obszarze dokumentów. W przeciwieństwie do tradycyjnych rozwiązań AI zależnych od zewnętrznych API lub usług chmurowych podmiotów trzecich, elDoc umożliwia pełne wdrożenie on-premise, gwarantując, że cała inteligencja dokumentowa pozostaje bezpiecznie w Twojej infrastrukturze.

⚙️ Elastyczne opcje wdrożenia

elDoc został zaprojektowany tak, aby dostosować się do każdego środowiska organizacyjnego, od niewielkich, zabezpieczonych instalacji po duże centra danych klasy enterprise:

- 💻 Lokalny laptop lub stacja robocza: idealne rozwiązanie dla środowisk poufnych lub odizolowanych, w których użytkownicy muszą analizować dokumenty bez dostępu do internetu.

- 🖥️ Serwery on-prem z GPU/CPU: doskonałe dla obciążeń działowych lub klasy enterprise, gdzie wymagana jest skalowalność, przetwarzanie równoległe i ciągłe działanie AI.

- ☁️ Wdrożenia w prywatnej chmurze lub VPC: dla organizacji korzystających z własnej infrastruktury chmurowej elDoc obsługuje pełną orkiestrację LLM w ramach Virtual Private Cloud (VPC), zapewniając lokalizację danych i zgodność z regulacjami przy jednoczesnym zachowaniu dynamicznej skalowalności.

🧩 Architektura i integracja

LLM jest hostowany lokalnie i w pełni zoptymalizowany w elDoc do zadań z zakresu inteligencji dokumentowej, takich jak ekstrakcja, podsumowywanie, klasyfikacja, wykrywanie anomalii czy ocena ryzyka. Integruje się bezproblemowo z główną platformą elDoc oraz warstwami danych za pośrednictwem bezpiecznych, wewnętrznych API:

/generate— do inteligentnego generowania tekstu, podsumowywania dokumentów oraz tworzenia projektów raportów./chat— do konwersacyjnych pytań i odpowiedzi, interaktywnej eksploracji dokumentów oraz wyszukiwania kontekstowego w danych wewnętrznych./extract_fields— do automatycznej ekstrakcji danych ustrukturyzowanych, walidacji kluczowych pól oraz kontroli spójności w wielu dokumentach./index— do automatycznego indeksowania i tagowania dokumentów, łączenia treści z metadanymi oraz natychmiastowego udostępniania ich do wyszukiwania w warstwie RAG./classify— do inteligentnej kategoryzacji dokumentów na podstawie treści, typu lub logiki biznesowej, na przykład faktury, umowy, sprawozdania finansowe, formularze HR./rename— do nadawania nazw dokumentom z wykorzystaniem AI zgodnie z niestandardowymi schematami, takimi jak dostawca, data, projekt czy typ klasyfikacji./analyze— do pogłębionej analizy dokumentów, rozpoznawania wzorców, wykrywania rozbieżności oraz identyfikowania ryzyk w dużych zbiorach danych.

Wszystkie połączenia działają zgodnie z rygorystycznymi zasadami modelu zero trust, są w pełni odizolowane od sieci zewnętrznych i nie obejmują przekazywania danych do zewnętrznych dostawców AI.

🧠 Wsparcie dla wielu, efektywnych kosztowo modeli LLM

elDoc jest rozwiązaniem niezależnym od konkretnego modelu i zostało zaprojektowane tak, aby wspierać szeroką gamę efektywnych kosztowo modeli LLM możliwych do lokalnego wdrożenia. Organizacje mogą wybrać lub zintegrować model najlepiej dopasowany do ich wymagań operacyjnych, finansowych i infrastrukturalnych.

- elDoc obsługuje modele LLM typu open source oraz komercyjne, zoptymalizowane pod kątem wdrożeń on-premise, w tym lekkie modele działające na standardowej infrastrukturze CPU oraz wysokowydajne rozwiązania wykorzystujące GPU do zaawansowanych obciążeń.

- Taka elastyczność umożliwia klientom zrównoważenie dokładności, szybkości i kosztów poprzez wdrożenie odpowiedniego modelu dla każdego scenariusza użycia, od niewielkich analiz wewnętrznych po przetwarzanie dokumentów na dużą skalę w środowisku enterprise.

- Modułowa architektura elDoc pozwala również na aktualizację, dostrajanie lub wymianę modelu bez wpływu na pozostałe elementy systemu, zapewniając długoterminową elastyczność wraz z rozwojem technologii AI.

🔒 Bezpieczeństwo i niezależność

Ponieważ całe wnioskowanie i przetwarzanie odbywa się w prywatnym środowisku, wrażliwe dane dokumentowe nigdy nie opuszczają organizacji. Gwarantuje to pełną suwerenność danych, zgodność z regulacjami oraz możliwość audytu, jednocześnie eliminując ryzyka związane z przetwarzaniem AI w chmurze.

Z elDoc każda operacja AI, od czytania i analizy umów po klasyfikację faktur czy generowanie raportów, jest realizowana przez Twój własny, prywatny LLM. Zachowujesz pełną kontrolę, przejrzystość i niezależność, jednocześnie korzystając z efektywności, skalowalności i optymalizacji kosztów, jakie zapewnia elastyczna, lokalna architektura AI.

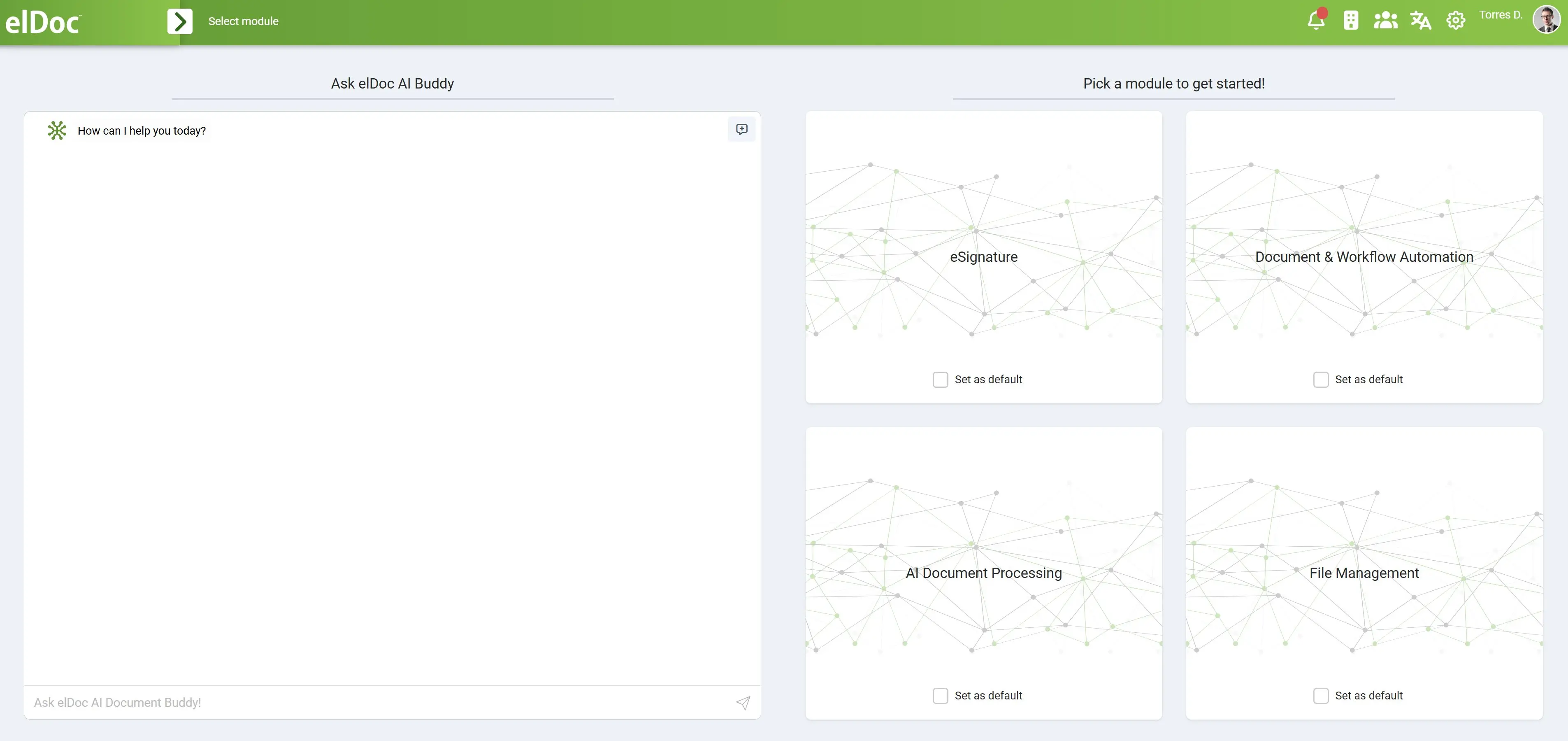

💼 5. Warstwa aplikacji – Inteligencja dokumentowa elDoc

Warstwa aplikacji to miejsce, w którym użytkownicy mogą w pełni doświadczyć mocy inteligentnego ekosystemu dokumentów elDoc — intuicyjnego, wielojęzycznego i bogatego w funkcje interfejsu, który łączy ludzi, dokumenty i AI w jednym, bezpiecznym środowisku.

🧭 Przyjazne dla użytkownika, wielojęzyczne doświadczenie

elDoc został zaprojektowany z myślą o dostępności i prostocie, dzięki czemu nawet złożone operacje AI są łatwe i naturalne dla użytkowników końcowych.

- 🌍 Interfejs platformy obsługuje obecnie wiele języków — angielski, hiszpański, chiński i ukraiński — co czyni go globalnie adaptowalnym i odpowiednim dla zespołów międzynarodowych.

- 🪄 Czysty, nowoczesny i responsywny design pozwala użytkownikom w naturalny sposób wchodzić w interakcję z dokumentami: zadawać pytania, wyszukiwać informacje, wyciągać dane czy automatyzować procesy — wszystko to za pomocą kilku kliknięć, bez potrzeby posiadania wiedzy technicznej.

Użytkownicy pracują całkowicie za pośrednictwem zunifikowanego interfejsu webowego, płynnie połączonego z warstwami AI, przechowywania danych i przepływu pracy.

⚙️ Zintegrowane moduły funkcjonalne

elDoc wykracza daleko poza tradycyjne systemy zarządzania dokumentami — to kompleksowa platforma automatyzacji inteligentnej z modułową architekturą. Każdy moduł jest ściśle zintegrowany z silnikiem LLM i ramami bezpieczeństwa, co zapewnia pełną kontrolę i elastyczność.

- ✍️ Podpis elektroniczny: umożliwia bezpieczne podpisywanie dokumentów, kierowanie procesów zatwierdzania oraz śledzenie audytów z zachowaniem zgodności prawnej i znacznikiem czasu.

- 🤝 Współpraca nad plikami: wielu użytkowników może współpracować w czasie rzeczywistym — przeglądać, komentować, adnotować lub edytować dokumenty współdzielone.

- 🔒 Bezpieczne udostępnianie plików: dziel się dokumentami na zewnątrz z zaawansowanymi kontrolami bezpieczeństwa, takimi jak uwierzytelnianie OTP, ochrona hasłem i ustawienie terminu wygaśnięcia linku.

- 🕒 Kontrola wersji: automatycznie utrzymuje historyczne wersje dokumentów, umożliwiając użytkownikom przeglądanie, porównywanie lub przywracanie wcześniejszych iteracji.

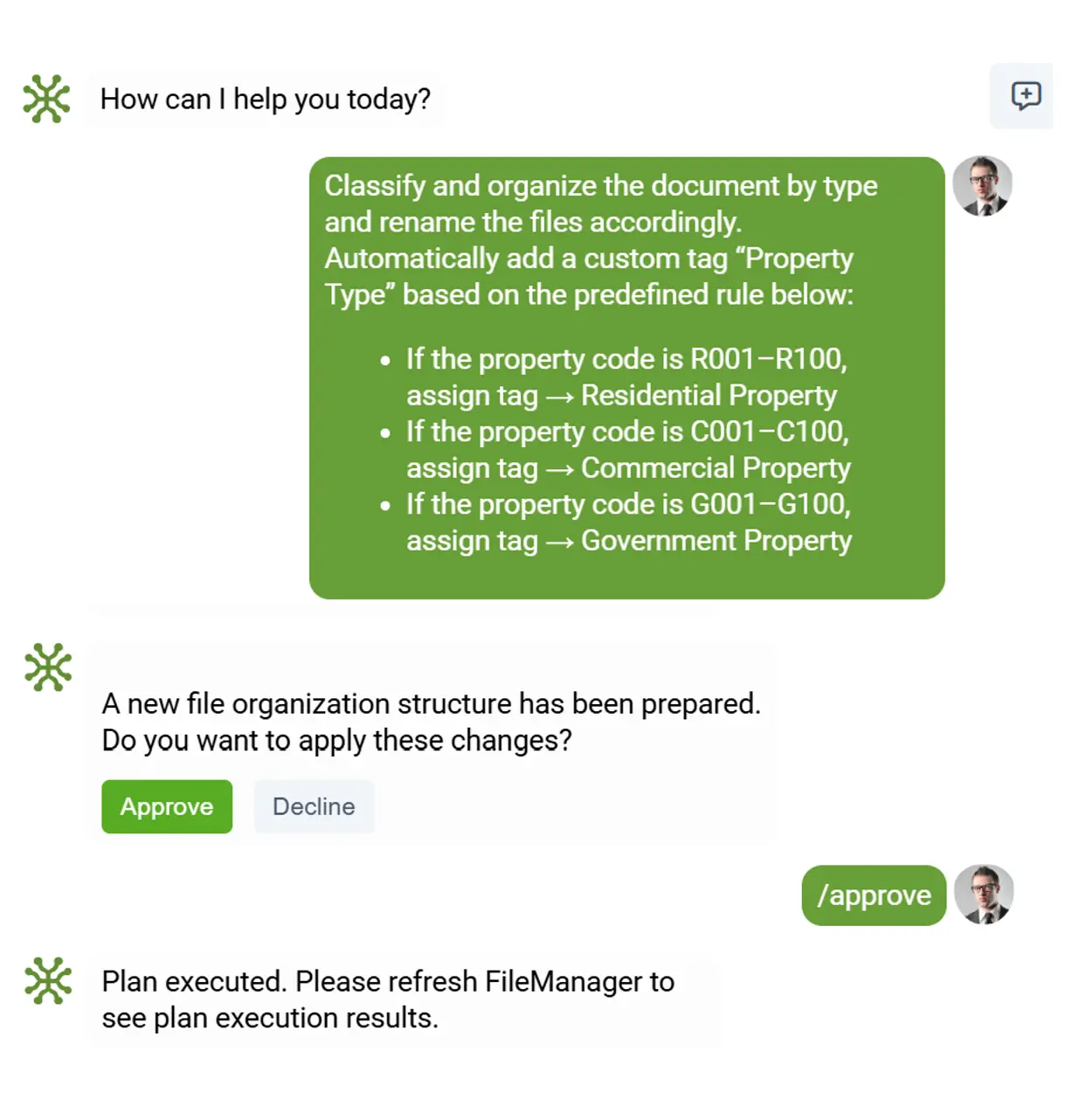

- 🧠 Inteligentne przetwarzanie dokumentów: wspiera klasyfikację, ekstrakcję, indeksowanie oraz zmianę nazw dokumentów z wykorzystaniem AI bezpośrednio w interfejsie.

- 🔄 Automatyzacja procesów (bez kodowania): użytkownicy mogą łatwo tworzyć i automatyzować procesy biznesowe bez pisania ani jednej linijki kodu, od zatwierdzania faktur po przegląd umów, umożliwiając płynną automatyzację między działami.

Każdy moduł działa w tym samym bezpiecznym środowisku i może być dostosowany do wewnętrznych zasad biznesowych, standardów zgodności lub wymagań regionalnych.

🤖 Aplikacje końcowego użytkownika zasilane sztuczną inteligencją

W interfejsie elDoc użytkownicy mogą bezpośrednio wchodzić w interakcję z komponentami LLM i AI, aby wykonywać szeroki zakres zadań związanych z inteligencją dokumentów:

- 🔍 Wyszukiwanie dokumentów w języku naturalnym i czat: zadawaj złożone pytania dotyczące milionów plików — LLM natychmiast dostarcza odpowiedzi uwzględniające kontekst, oparte na Twoich własnych dokumentach.

- 📊 Automatyczna ekstrakcja i weryfikacja danych: wydobywaj kluczowe wartości z faktur, umów, raportów lub zestawień z wysoką dokładnością i automatycznymi regułami walidacji.

- 🗂️ Klasyfikacja i zmiana nazw dokumentów: automatycznie kategoryzuj, taguj i zmieniaj nazwy plików według typu, dostawcy, roku lub działu, wykorzystując logikę opartą na AI.

- ⚠️ Analiza ryzyka i wykrywanie anomalii: identyfikuj rozbieżności, brakujące dokumenty lub nieregularne wzorce danych w powiązanych plikach (np. faktury a umowy).

Wszystkie te operacje są obsługiwane przez lokalne środowisko AI elDoc oraz inteligencję dokumentów opartą na RAG, co zapewnia, że każde wyszukiwanie i działanie pozostaje bezpieczne, możliwe do śledzenia i zgodne z regulacjami.

🧰 Narzędzia administracyjne i warstwa integracyjna w elDoc

Dla administratorów elDoc oferuje zaawansowane centrum kontroli do zarządzania konfiguracją, uprawnieniami i integracjami:

- Zcentralizowany pulpit nawigacyjny do monitorowania przepływów pracy, aktywności dokumentów i stanu systemu.

- Kompleksowe dzienniki audytu śledzące każde uzyskanie dostępu do dokumentów i zdarzenia w przepływach pracy.

- Interfejsy API integracyjne łączące elDoc z kluczowymi systemami przedsiębiorstwa, takimi jak ERP, AP, CRM, zapewniając płynny przepływ danych w całej organizacji.

- Obsługuje eksport danych w wielu formatach (JSON, CSV) do analiz, raportowania lub synchronizacji z systemami zewnętrznymi.

Warstwa bezpieczeństwa i zarządzania — Pełna kontrola, zgodność i ochrona danych

W elDoc bezpieczeństwo i zarządzanie nie są funkcjami dodatkowymi — są fundamentem. Każdy komponent, od bazy danych po warstwę AI, opiera się na zasadach zero-trust, zapewniając, że użytkownicy, systemy i modele AI mają dostęp wyłącznie do tego, do czego są wyraźnie upoważnieni. W miarę jak organizacje wdrażają AI do przetwarzania dokumentów, jednym z kluczowych wyzwań jest zapobieganie nieautoryzowanemu dostępowi do informacji. Nie każdy pracownik, dział ani zapytanie AI powinno mieć możliwość odczytu danych, do których nie ma uprawnień. elDoc rozwiązuje to poprzez szczegółową kontrolę uprawnień, zarządzanie oparte na rolach oraz wielowarstwowe egzekwowanie bezpieczeństwa w całej platformie.

🧩 Model bezpieczeństwa wielowarstwowego

elDoc wdraża wiele powiązanych ze sobą warstw bezpieczeństwa, zaprojektowanych w celu ochrony Twoich danych na każdym etapie — od przechwytywania i przechowywania po analizę AI i udostępnianie:

- Bezpieczeństwo na poziomie aplikacji

- Wszyscy użytkownicy uwierzytelniają się poprzez Single Sign-On (SSO) lub systemy zarządzania tożsamością oparte na katalogach (np. Azure AD, Okta).

- Uwierzytelnianie wieloskładnikowe (MFA) dodaje dodatkową warstwę weryfikacji, chroniąc przed nieautoryzowanym logowaniem.

- Dostęp za pomocą jednorazowego hasła (OTP) może być wymuszony przy operacjach krytycznych lub udostępnianiu plików na zewnątrz.

- Kontrola dostępu oparta na rolach (RBAC)

- Każdemu użytkownikowi przypisuje się konkretne role — np. Przeglądający, Edytor, Zatwierdzający, Administrator lub Analityk AI — określające dokładnie, jakie działania może wykonywać w systemie.

- Uprawnienia obejmują również pojedyncze działania (przeglądanie, edycja, pobieranie, usuwanie, udostępnianie lub podpisywanie).

- Administratorzy mogą tworzyć niestandardowe role i grupy uprawnień, dopasowując polityki bezpieczeństwa do potrzeb działów lub wymagań zgodności.

- Zarządzanie dostępem AI

- elDoc wprowadza kontrolę uprawnień na poziomie AI, zapewniając, że LLM może pobierać i analizować tylko te dokumenty, do których użytkownik ma uprawnienia.

- Zapobiega to „nadmiernej ekspozycji AI” — gdy ktoś mógłby próbować pytać model o dane ograniczone (np. informacje HR, prawne lub finansowe).

- Wszystkie zapytania AI są filtrowane przez profil dostępu użytkownika, dzięki czemu proces pobierania danych przez model przestrzega tych samych zasad widoczności co warstwa danych.

- Ochrona danych i szyfrowanie

- Wszystkie dokumenty i metadane są szyfrowane w spoczynku za pomocą natywnego silnika szyfrowania MongoDB oraz podczas transmisji za pomocą TLS 1.3.

- elDoc obsługuje szyfrowanie na poziomie pól dla danych wrażliwych (np. dane osobowe, informacje płatnicze, identyfikatory klientów).

- Bezpieczne zarządzanie kluczami zapewnia, że klucze szyfrowania pozostają pod kontrolą klienta — nigdy nie są ujawniane systemom zewnętrznym.

- Bezpieczeństwo sieci i izolacja

- Cała platforma może działać w pełni offline lub w wyodrębnionej sieci wewnętrznej, zapewniając brak transmisji danych na zewnątrz.

- Wewnętrzne API komunikują się przez bezpieczne, uwierzytelnione kanały.

- Bramki API egzekwują reguły zapory, ograniczenia przepustowości oraz uwierzytelnianie oparte na certyfikatach.

- Monitorowanie, audyt i zgodność

- elDoc oferuje pulpity monitorujące w czasie rzeczywistym, pokazujące aktywności użytkowników, interakcje AI i wydajność systemu.

- Każdy dostęp, zmiana i zapytanie AI jest rejestrowane z pełnymi metadanymi audytu (ID użytkownika, ID dokumentu, znacznik czasu, typ działania).

Wprowadź AI / LLM do swoich dokumentów — bezpiecznie i lokalnie z elDoc

Wdrożenie technologii AI i LLM na miejscu to nie tylko wybór techniczny — to najbezpieczniejszy i przyszłościowy sposób na korzystanie z nowoczesnych możliwości AI przy zachowaniu pełnej kontroli nad danymi. Budowa takiej architektury od podstaw mogłaby zająć lata badań, rozwoju i integracji.

elDoc przyspiesza tę drogę dzięki sprawdzonej, gotowej do produkcji platformie, która ewoluowała przez lata wdrożeń praktycznych w różnych branżach, funkcjach biznesowych i krajach. Każdy komponent elDoc — od inteligentnego przetwarzania dokumentów i automatyzacji przepływów pracy po eSignature, współpracę i lokalną integrację LLM — odzwierciedla doświadczenie z realnych wdrożeń i niezawodność klasy korporacyjnej.

Wdrażając elDoc, organizacje uzyskują natychmiastowy dostęp do inteligencji dokumentów wspieranej przez LLM, automatyzacji przepływów pracy i bezpiecznego zarządzania danymi — wszystko w zintegrowanym środowisku lokalnym lub prywatnej chmury. To nie tylko przyjęcie AI — to przyjęcie AI z wbudowanym celem, bezpieczeństwem i doświadczeniem.

elDoc łączy wszystko, czego potrzebujesz, aby zarządzać, rozumieć i automatyzować swoje dokumenty — napędzane przez LLM, zaprojektowane z myślą o bezpieczeństwie i sprawdzone w praktyce.

Skontaktuj się z nami

Pobierz bezpłatną wersję elDoc Community i wdrażaj wybrany model LLM lokalnie

Uzyskaj odpowiedzi na swoje pytania lub umów się na prezentację, by zobaczyć nasze rozwiązanie w działaniu — po prostu napisz do nas