Offline RAG do czatu z dokumentami w elDoc

W ciągu ostatnich dwóch lat miliony użytkowników przekonały się o możliwościach narzędzi takich jak ChatGPT, Gemini oraz podobnych asystentów GenAI. Są szybkie, intuicyjne i robią duże wrażenie. Można przesłać dokument, zadać pytanie i w ciągu kilku sekund otrzymać odpowiedź. Jednak bardziej doświadczeni użytkownicy szybko dostrzegają podstawowe ograniczenie:

Narzędzia te przetwarzają Twoje dokumenty w chmurze, poza Twoją kontrolą.

W przypadku okazjonalnego użycia może to być akceptowalne. W przypadku danych wrażliwych zdecydowanie nie.

Ukryty problem bezpieczeństwa i zgodności w chmurowych asystentach GenAI

Gdy dokumenty są przesyłane do publicznych usług GenAI, przestają pozostawać w lokalnym środowisku organizacji. Przetwarzanie odbywa się w infrastrukturze podmiotów trzecich, często rozproszonej pomiędzy różnymi regionami, gdzie lokalizacja danych, polityki ich przechowywania oraz wtórne wykorzystanie nie zawsze są w pełni transparentne. Mechanizmy kontroli dostępu są zazwyczaj ogólne i zaprojektowane z myślą o szerokim zastosowaniu konsumenckim, a nie o zarządzaniu klasy korporacyjnej. W rezultacie zespoły ds. bezpieczeństwa i zgodności dysponują ograniczoną widocznością, słabą ścieżką audytową oraz niewielką kontrolą nad tym, w jaki sposób przetwarzane są wrażliwe informacje.

Takie luki tworzą poważne ryzyko podczas pracy z dokumentacją finansową, umowami prawnymi, dokumentami medycznymi i ubezpieczeniowymi, materiałami roboczymi z audytu czy wewnętrzną wiedzą organizacji. W przypadku firm działających w ramach regulacji takich jak RODO, regulacje finansowe czy branżowe standardy zgodności, brak kontroli nad danymi bywa wystarczającym powodem, aby całkowicie zrezygnować z korzystania z publicznych narzędzi GenAI.

Problem skalowalności chmurowych asystentów GenAI, o którym rzadko się mówi

Kolejny problem staje się nieunikniony przy większej skali działania. Przesyłanie terabajtów dokumentów za każdym razem, gdy potrzebna jest analiza, nie ma większego sensu. Większość organizacji posiada już rozbudowane i dobrze zabezpieczone repozytoria dokumentów w udostępnionych zasobach plikowych, systemach zarządzania dokumentami, prywatnych chmurach czy archiwach lokalnych. Wielokrotne wysyłanie tych samych danych do zewnętrznych usług AI jest nieefektywne, kosztowne, powolne i wprowadza niepotrzebne ryzyko operacyjne. Znacznie bardziej praktyczne podejście polega na tym, aby dokumenty pozostawały bezpiecznie wewnątrz infrastruktury organizacji, były jednorazowo indeksowane przy użyciu AI, a następnie inteligentnie przeszukiwane zawsze wtedy, gdy potrzebne są konkretne wnioski lub informacje.

Co w praktyce oznacza „Fully Offline RAG” dla rozmowy z dokumentami i czy jest to rzeczywiście możliwe

Gdy ludzie słyszą o możliwości „rozmowy z dokumentami”, często zakładają, że jakaś część procesu musi opierać się na internecie lub zewnętrznych usługach AI. W rzeczywistości w pełni offline’owe podejście Retrieval-Augmented Generation (RAG) jest nie tylko możliwe, ale już dziś może być stosowane w środowiskach produkcyjnych, o ile platforma została zaprojektowana we właściwy sposób.

W swojej istocie RAG to wzorzec architektoniczny, który pozwala systemom GenAI niezawodnie pracować z prywatnymi dokumentami. Zamiast oczekiwać, że model językowy będzie „zgadywał” odpowiedzi, system najpierw wyszukuje najbardziej trafne fragmenty w zaufanym wewnętrznym zbiorze dokumentów, a następnie generuje odpowiedź opartą wyłącznie na odnalezionej treści. To właśnie sprawia, że rozmowa z dokumentami jest dokładna, możliwa do wyjaśnienia i użyteczna w rzeczywistych scenariuszach biznesowych.

O tym, że rozwiązanie jest w pełni offline, nie decyduje sam interfejs rozmowy, lecz fakt, że każdy etap tego procesu działa całkowicie wewnątrz własnej infrastruktury organizacji — zarówno lokalnie (on-premises), jak i w prywatnej chmurze. Żadna treść dokumentów, metadane, embeddingi, zapytania ani odpowiedzi nie są przekazywane do zewnętrznych interfejsów API.

Tak, jest to możliwe, a elDoc został zaprojektowany właśnie po to, aby takie podejście było praktyczne w realnym zastosowaniu.

Jak elDoc umożliwia w pełni offline’ową rozmowę z dokumentami

elDoc to platforma GenAI dostępna w modelu wdrożeń w pełni lokalnych (on-premise), w środowiskach odizolowanych od sieci (air-gapped) oraz w prywatnych chmurach. Jest dostarczana jako kompletny, samodzielny system zawierający wszystkie komponenty niezbędne do offline’owego rozumienia dokumentów, ich wyszukiwania oraz prowadzenia interakcji konwersacyjnej.

Proces rozpoczyna się od wczytywania i analizy dokumentów. elDoc integruje wiele silników OCR, aby poradzić sobie z różnorodnością i niespójnością dokumentów spotykanych w rzeczywistych środowiskach pracy. W zależności od wymagań wdrożeniowych obejmuje to m.in. OCR open source do ogólnej ekstrakcji danych, wysokoprecyzyjny OCR dla złożonych układów dokumentów, modele vision-language z wbudowanym rozumieniem struktury oraz ultraszybki wielojęzyczny OCR do przetwarzania na dużą skalę. Ta elastyczność pozwala organizacjom równoważyć dokładność, szybkość i rygorystyczne wymagania dotyczące pracy offline.

Zanim jakikolwiek model językowy rozpocznie analizę dokumentu, elDoc wykorzystuje warstwę computer vision, która oczyszcza, normalizuje i optymalizuje obrazy dokumentów. Przekrzywione skany, niski kontrast, zakłócone tło, tabele, pieczęcie i podpisy są korygowane oraz odpowiednio strukturyzowane, dzięki czemu kolejne modele AI pracują na danych wejściowych wysokiej jakości.

Po optymalizacji dokumentów lokalnie uruchamiane duże modele językowe zapewniają rzeczywiste zrozumienie semantyczne. Modele te nie ograniczają się do samej ekstrakcji tekstu. Interpretują znaczenie, kontekst, zależności oraz intencję w obrębie akapitów, tabel i sekcji. Dzięki temu użytkownicy mogą zadawać naturalne pytania zamiast wykonywać wyszukiwania oparte wyłącznie na słowach kluczowych.

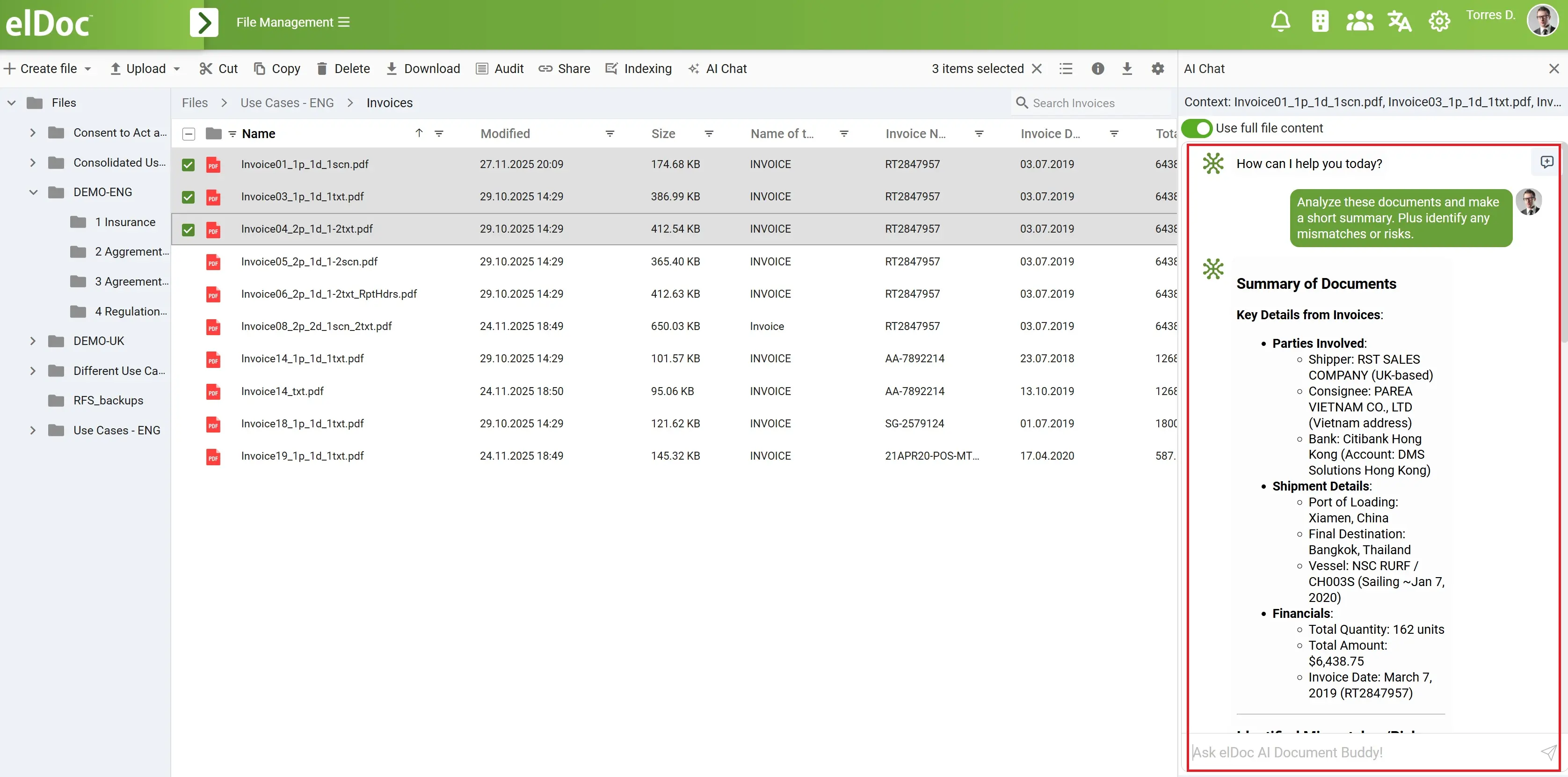

Rozmowa z dokumentami: od użytku prywatnego do inteligencji dokumentowej w skali przedsiębiorstwa

Po wdrożeniu elDoc dokumenty przestają być statycznymi plikami przechowywanymi w folderach. Stają się bezpieczną, interaktywną bazą wiedzy, którą użytkownicy mogą przeszukiwać przy użyciu języka naturalnego. Zamiast otwierać pliki jeden po drugim, ręcznie je przeszukiwać czy eksportować dane do zewnętrznych narzędzi, użytkownicy po prostu rozmawiają ze swoimi dokumentami w w pełni offline’owym i zarządzanym środowisku.

Dla użytkowników indywidualnych elDoc zapewnia przejrzystość i poczucie bezpieczeństwa podczas pracy z bardzo wrażliwymi dokumentami osobistymi. Użytkownicy mogą analizować dokumentację medyczną, polisy ubezpieczeniowe czy umowy prawne bez ujawniania prywatnych danych publicznym platformom GenAI. Typowe zapytania obejmują:

„Przeanalizuj moją dokumentację medyczną i wskaż brakujące informacje lub niespójności, które mogą mieć wpływ na leczenie albo zakres mojego ubezpieczenia.”

„Na podstawie mojej polisy ubezpieczeniowej sprawdź, czy to roszczenie jest objęte ochroną oraz czy istnieją wyłączenia lub warunki, o których powinienem wiedzieć.”

W małych i średnich organizacjach elDoc staje się codziennym narzędziem zwiększającym produktywność zespołów finansowych, operacyjnych i prawnych. Zamiast ręcznie przeglądać pliki, zespoły mogą zadawać pytania dotyczące całych zbiorów dokumentów jednocześnie i natychmiast uzyskiwać wnioski na podstawie faktur, umów czy korespondencji. Typowe zapytania obejmują:

„Wśród wszystkich faktur i umów zidentyfikuj zaległe płatności, niespójne warunki oraz wszelkie rozbieżności między uzgodnionymi a zafakturowanymi kwotami.”

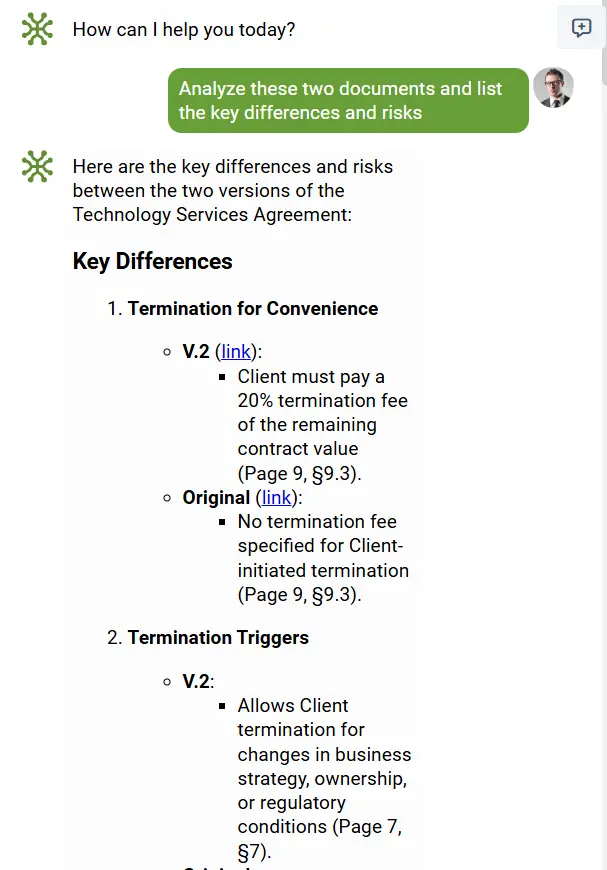

Na poziomie przedsiębiorstwa elDoc umożliwia bezpieczną analizę dokumentów na dużą skalę w różnych działach i regionach, przy jednoczesnym egzekwowaniu ścisłej kontroli dostępu i pełnej audytowalności. Zespoły finansowe, prawne, audytowe i compliance mogą zadawać złożone pytania obejmujące wiele dokumentów, które w innym przypadku wymagałyby dni lub tygodni pracy manualnej. Typowe zapytania obejmują:

„Porównaj wszystkie wersje umów i wskaż zapisy dotyczące rozwiązania umowy, odpowiedzialności oraz kar, które odbiegają od naszej standardowej polityki.”

„Przeanalizuj dokumentację roboczą z audytów z ostatnich trzech lat i wskaż istotne zmiany, anomalie lub brakujące dokumenty potwierdzające.”

We wszystkich scenariuszach użycia doświadczenie pozostaje spójne: dokumenty pozostają bezpiecznie w Twoim środowisku, uprawnienia są egzekwowane automatycznie, a każda odpowiedź opiera się na rzeczywistej treści zatwierdzonych dokumentów. elDoc dostarcza konwersacyjne GenAI dla rzeczywistych dokumentów biznesowych bez kompromisów w zakresie prywatności, bezpieczeństwa i kontroli.

Przechowywanie, wyszukiwanie i inteligencja semantyczna – wszystko w trybie offline

W pełni offline’owy RAG wymaga również solidnych warstw przechowywania i wyszukiwania danych. elDoc wykorzystuje skalowalny magazyn dokumentów, który umożliwia efektywne zarządzanie zarówno dużymi plikami, jak i bogatymi metadanymi, zapewniając ich dostępność, wersjonowanie oraz możliwość audytu w czasie. Dodatkowo dedykowana baza wektorowa lokalnie tworzy embeddingi semantyczne, nadając dokumentom „znaczenie”, które można wyszukiwać nie tylko na podstawie słów kluczowych. Dzięki temu system potrafi odnaleźć istotne treści nawet wtedy, gdy użytkownik formułuje pytania niedokładnie lub w języku naturalnym.

Aby zapewnić dokładne dopasowanie i szybkie filtrowanie, elDoc łączy wyszukiwanie semantyczne z funkcjami wyszukiwania pełnotekstowego. Rezultatem jest hybrydowe podejście do wyszukiwania, które działa niezawodnie w przypadku umów, faktur, wyciągów, polityk oraz zeskanowanych dokumentów, bez konieczności korzystania z zasobów poza środowiskiem organizacji.

Jak łatwo wdrożyć elDoc i rozpocząć rozmowę z dokumentami?

Mimo zaawansowanej architektury wymaganej do obsługi w pełni offline’owej rozmowy z dokumentami, obejmującej bezpieczne przechowywanie danych, silniki OCR, computer vision, lokalne modele LLM, wyszukiwanie semantyczne oraz mechanizmy zarządzania, wdrożenie elDoc jest celowo uproszczone. Cała złożoność została wbudowana w platformę, a nie przeniesiona na użytkownika czy zespół IT.

elDoc jest dostarczany jako rozwiązanie konteneryzowane, co umożliwia jego spójne wdrażanie w różnych środowiskach. Niezależnie od tego, czy jesteś indywidualnym użytkownikiem, małym zespołem czy dużym przedsiębiorstwem, wdrożenie przebiega według tego samego prostego schematu: uruchom kontener w swojej infrastrukturze on-premise lub w prywatnej chmurze. Nie ma potrzeby składania oddzielnych komponentów, integrowania wielu dostawców ani zarządzania złożonymi potokami przetwarzania — wszystko, co potrzebne do bezpiecznej rozmowy z dokumentami, jest już przygotowane i gotowe do użycia.

Po wdrożeniu rozpoczęcie pracy jest natychmiastowe. Wystarczy podłączyć wybrany duży model językowy zgodnie z dostępnymi zasobami sprzętowymi — czy będzie to konfiguracja oparta wyłącznie na CPU, przyspieszona przez GPU, czy też środowisko hybrydowe. elDoc jest niezależny od konkretnego modelu, dzięki czemu organizacje mogą wybrać LLM najlepiej dopasowany do wymagań dotyczących wydajności, kosztów i bezpieczeństwa, przy jednoczesnym zachowaniu w pełni lokalnego przetwarzania.

Następnie użytkownicy po prostu przesyłają dokumenty lub łączą istniejące repozytoria, uruchamiają indeksowanie i rozpoczynają rozmowę z dokumentami. Nowe pliki można dodawać w dowolnym momencie i są one automatycznie uwzględniane w kolejnych zapytaniach bez konieczności ponownego przetwarzania wcześniej zindeksowanych danych. Od pierwszego wdrożenia do prowadzenia realnych rozmów z dokumentami elDoc przekształca to, co tradycyjnie było złożonym projektem infrastruktury GenAI, w praktyczne, powtarzalne i bezpieczne rozwiązanie.

Krótko mówiąc, elDoc udostępnia w pełni offline’ową rozmowę z dokumentami na poziomie klasy korporacyjnej bez rezygnacji z kontroli, elastyczności ani łatwości wdrożenia.

elDoc Community Edition: lokalny RAG dla Twoich dokumentów

Aby umożliwić korzystanie z w pełni offline’owej inteligencji dokumentowej także poza dużymi przedsiębiorstwami, elDoc jest dostępny również w wersji Community Edition. Wersja ta została zaprojektowana z myślą o użytkownikach indywidualnych, programistach oraz małych zespołach, które chcą uruchamiać rozmowę z dokumentami opartą na RAG lokalnie — na laptopie, stacji roboczej lub niewielkim serwerze — bez wysyłania dokumentów do chmury.

Community Edition zapewnia podstawowe funkcje potrzebne do bezpiecznej rozmowy z dokumentami. Użytkownicy mogą przesyłać pliki, indeksować je lokalnie i zadawać pytania w języku naturalnym dotyczące całej kolekcji dokumentów. Całe przetwarzanie odbywa się na lokalnym komputerze lub w prywatnym środowisku użytkownika, co gwarantuje pełną prywatność danych i kontrolę nad nimi. Brak zależności od zewnętrznych usług AI sprawia, że jest to idealne rozwiązanie do eksperymentowania z GenAI na wrażliwych dokumentach.

Pomimo swojej lekkości Community Edition nadal opiera się na tych samych zasadach architektonicznych co platforma klasy enterprise. Dokumenty są przetwarzane z wykorzystaniem OCR i computer vision, indeksowane w lokalnym magazynie semantycznym, a następnie przeszukiwane poprzez potok RAG wspierany przez lokalnie uruchomiony model językowy. Użytkownicy po prostu podłączają model LLM dopasowany do dostępnych zasobów sprzętowych — CPU lub GPU — i rozpoczynają rozmowę z dokumentami.

elDoc Community Edition jest idealny dla:

- małych zespołów, które chcą uruchomić rozwiązanie lokalnie

- testowania procesów rozmowy z dokumentami przed wdrożeniem w skali przedsiębiorstwa

- użytkowników dbających o prywatność, którzy chcą korzystać z pomocy AI bez ujawniania danych w chmurze

Dzięki elDoc Community Edition zaawansowana rozmowa z dokumentami nie jest już ograniczona do złożonych wdrożeń korporacyjnych. Rozwiązanie to udostępnia bezpieczną, lokalną inteligencję dokumentową opartą na RAG każdemu, kto chce pracować z dokumentami w sposób prywatny i efektywny.

Co zawiera elDoc Community Edition: pełny lokalny stos AI

elDoc Community Edition nie jest okrojoną wersją demonstracyjną. To w pełni funkcjonalna lokalna platforma RAG, która obejmuje kompletny potok AI niezbędny do ekstrakcji, rozumienia, wyszukiwania oraz prowadzenia rozmów z dokumentami, działający w całości na Twoim komputerze lub w lokalnym środowisku.

Choć architektura rozwiązania jest zaawansowana, wszystkie komponenty są wstępnie zintegrowane i odpowiednio zestawione. Efektem jest płynne doświadczenie pracy: wystarczy przesłać dokumenty, jednorazowo je zindeksować i rozpocząć zadawanie pytań bez szablonów, ręcznej konfiguracji ani zależności od chmury.

Poniżej przedstawiono pełny stos technologiczny dostępny w elDoc Community Edition.

OCR — przekształcanie obrazów i plików PDF w tekst

Większość dokumentów, zwłaszcza faktur, trafia do organizacji w postaci skanów, obrazów lub plików PDF bez możliwości wyszukiwania tekstu. OCR jest pierwszym kluczowym etapem, który przekształca te pliki w tekst możliwy do odczytania przez systemy informatyczne, dzięki czemu AI może faktycznie je zrozumieć.

W Community Edition elDoc zawiera silniki OCR działające w trybie offline, w tym:

- Tesseract OCR – silnik OCR open source przeznaczony do ogólnej ekstrakcji tekstu

- PaddleOCR – bardzo szybki, wielojęzyczny OCR zoptymalizowany pod kątem różnorodnych układów i formatów dokumentów

- Qwen3-VL – OCR typu vision-language z wbudowanym rozumieniem struktury dokumentu, przeznaczony do pracy ze złożonymi dokumentami

Silniki te umożliwiają dokładną ekstrakcję tekstu z zaszumionych, niskiej jakości lub wielojęzycznych dokumentów, przy zachowaniu w pełni lokalnego przetwarzania danych.

Computer Vision — oczyszczanie i normalizacja dokumentów

Zanim wyniki OCR zostaną przekazane do modeli AI, elDoc stosuje dedykowaną warstwę wstępnego przetwarzania computer vision. Ten etap znacząco poprawia dokładność i niezawodność dalszej analizy.

Warstwa computer vision wykonuje prostowanie i wyrównywanie obróconych stron, redukcję szumów i poprawę kontrastu oraz normalizację układu dokumentu. Dzięki standaryzacji nieuporządkowanych dokumentów z rzeczywistych środowisk pracy elDoc zapewnia, że kolejne modele AI działają na czystych i uporządkowanych danych wejściowych — jednym z kluczowych czynników skutecznego działania RAG.

LLM — rzeczywiste zrozumienie treści

Sercem elDoc Community Edition jest lokalnie uruchomiony duży model językowy (LLM). Model ten działa jako silnik wnioskowania, który rozumie dokumenty w sposób zbliżony do człowieka, lecz szybciej i bardziej konsekwentnie.

LLM interpretuje znaczenie, kontekst i intencję w nieustrukturyzowanym tekście, tabelach i sekcjach dokumentów. Wyodrębnia kluczowe pola, takie jak sumy, daty, podatki, dostawcy czy pozycje dokumentu, klasyfikuje dokumenty bez użycia szablonów oraz wykrywa niespójności i anomalie. To właśnie umożliwia zadawanie pytań w języku naturalnym zamiast korzystania ze sztywnych reguł lub wyszukiwania opartego wyłącznie na słowach kluczowych.

Użytkownicy po prostu podłączają model LLM dopasowany do dostępnych zasobów sprzętowych — CPU lub GPU — a elDoc zajmuje się resztą.

RAG — łączenie kontekstu pomiędzy dokumentami

Retrieval-Augmented Generation (RAG) przekształca pojedyncze dokumenty w powiązaną bazę wiedzy. W elDoc Community Edition mechanizm RAG umożliwia systemowi wyszukiwanie istotnych fragmentów w wielu dokumentach i wykorzystywanie ich jako wiarygodnego kontekstu dla odpowiedzi generowanych przez AI. Dzięki temu użytkownicy mogą weryfikować dane pomiędzy plikami, wykrywać niespójności oraz zadawać złożone pytania obejmujące wiele dokumentów, na przykład porównywać faktury, sprawdzać zgodność z umowami lub analizować trendy w całym zbiorze danych.

RAG zapewnia, że odpowiedzi zawsze opierają się na rzeczywistej treści dokumentów, a nie na przypuszczeniach czy tzw. halucynacjach modeli AI.

MongoDB — skalowalne przechowywanie dokumentów

MongoDB pełni w elDoc rolę głównego repozytorium dokumentów i metadanych. Efektywnie zarządza zarówno dużymi plikami, jak i wynikami strukturalnej ekstrakcji danych, nawet gdy struktury dokumentów znacząco się różnią. Elastyczny schemat danych, szybkie wyszukiwanie i wysoka niezawodność sprawiają, że rozwiązanie to idealnie nadaje się do lokalnych procesów analizy dokumentów, stanowiąc fundament warstwy danych strukturalnych w elDoc.

Qdrant — inteligencja semantyczna i wyszukiwanie wektorowe

Qdrant zapewnia rozumienie semantyczne dzięki wektorowym embeddingom generowanym lokalnie. Umożliwia elDoc odnajdywanie znaczeń wykraczających poza same słowa kluczowe — wykrywanie podobnych dokumentów, duplikatów oraz powiązań między plikami. Ta warstwa semantyczna jest kluczowa dla inteligentnego wyszukiwania, grupowania dokumentów oraz precyzyjnego odpowiadania na pytania w oparciu o RAG.

Apache Solr — szybkie wyszukiwanie pełnotekstowe

Apache Solr uzupełnia wyszukiwanie semantyczne o indeksowanie słów kluczowych klasy korporacyjnej. Umożliwia natychmiastowe wyszukiwanie pełnotekstowe, filtrowanie, ranking oraz nawigację w dużych zbiorach dokumentów.

Razem Solr i Qdrant tworzą hybrydowy silnik wyszukiwania — łączący precyzję wyszukiwania słów kluczowych z rozumieniem semantycznym i wnioskowaniem AI.

Validation Station — ocena jakości, poziom zaufania i zarządzanie wyjątkami

Oprócz samej ekstrakcji danych elDoc zawiera moduł Validation Station, który ocenia jakość i wiarygodność wyników generowanych przez AI.

Warstwa ta przypisuje poziomy zaufania do wyodrębnionych pól, oznacza dane o niskiej pewności lub sprzeczne oraz identyfikuje przypadki wymagające weryfikacji przez człowieka. Reguły walidacji mogą być stosowane w wielu dokumentach w celu wykrywania brakujących pól, niespójnych wartości, przekroczenia progów lub rozbieżności pomiędzy powiązanymi plikami (np. fakturami a umowami lub politykami). Validation Station umożliwia realizację procesu human-in-the-loop, zapewniając, że wyniki AI są przejrzyste, możliwe do audytu i gotowe do użycia produkcyjnego, zamiast funkcjonować jako nieprzejrzyste „czarne skrzynki”.

Solidne ramy bezpieczeństwa — role, uprawnienia i zarządzanie

Bezpieczeństwo jest wbudowane w elDoc od podstaw, również w wersji Community Edition. Platforma obejmuje mechanizm kontroli dostępu oparty na rolach (RBAC), który jasno definiuje role i odpowiedzialności użytkowników oraz zespołów. Uprawnienia mogą być stosowane na poziomie przestrzeni roboczej, folderów, dokumentów oraz funkcji systemu, w tym dostępu do funkcji GenAI takich jak indeksowanie, rozmowa z dokumentami, eksport czy udostępnianie plików.

elDoc obsługuje uwierzytelnianie wieloskładnikowe (MFA) w celu zapewnienia bezpiecznego dostępu i może być integrowany z korporacyjnymi dostawcami tożsamości, w tym z Active Directory (AD) lub systemami uwierzytelniania opartymi na katalogach. Zapewnia to spójne zarządzanie tożsamością, scentralizowaną kontrolę użytkowników oraz zgodność z obowiązującymi politykami bezpieczeństwa.

Wszystkie działania są rejestrowane, tworząc przejrzystą ścieżkę audytową dotyczącą dostępu do dokumentów, interakcji z AI oraz decyzji walidacyjnych, co ma kluczowe znaczenie dla zgodności regulacyjnej, zarządzania i budowania zaufania.

Oprócz funkcji bezpieczeństwa i zarządzania elDoc wspiera także wdrożenia o wysokiej dostępności. Dzięki architekturze kontenerowej platforma może być uruchamiana w konfiguracjach klastrowych lub replikowanych, eliminując pojedyncze punkty awarii. Umożliwia to organizacjom zapewnienie ciągłego dostępu do inteligencji dokumentowej, skalowanie obciążeń pomiędzy węzłami oraz utrzymanie odporności operacyjnej nawet podczas prac serwisowych lub zakłóceń infrastruktury.

Łącznie te możliwości sprawiają, że elDoc nadaje się nie tylko do eksperymentów, lecz także do bezpiecznej, niezawodnej i stale dostępnej analizy dokumentów — od użytkowników indywidualnych po krytyczne wdrożenia w środowiskach przedsiębiorstw.

Skontaktuj się z nami

Pobierz bezpłatną wersję elDoc Community i wdrażaj wybrany model LLM lokalnie

Uzyskaj odpowiedzi na swoje pytania lub umów się na prezentację, by zobaczyć nasze rozwiązanie w działaniu — po prostu napisz do nas