搭載 Agentic RAG 與 AI 代理的企業級 AI 平台:部署場景

在企業層級導入人工智慧,與使用公共 AI 服務在本質上截然不同。適用於實驗或個人生產力的方式,無法直接應用於資料敏感、流程複雜且責任要求嚴格的環境。企業需要穩健的架構、嚴格的治理機制,以及對 AI 運作方式、資料存取與行動執行的全面掌控。因此,AI 不能被視為單純的 API 層,而必須被設計為可擴展、安全且靈活的系統,並能深度整合企業資料、工作流程與權限管理。

隨著組織從實驗階段邁向實際導入 AI,有一個問題變得至關重要:

「AI 應該在哪裡運行,以及如何運行?」

對於企業環境,尤其是處理敏感、受監管或高價值資料的情境,答案很少是「只需使用雲端」。這需要在控制力、效能、合規性與創新之間取得審慎平衡。

這正是 elDoc 與眾不同之處。作為結合 Agentic RAG 與 AI 代理的企業級 AI 平台,elDoc 以架構為核心進行設計,而非事後補強。它支援多種部署模式,從完全地端部署到混合與雲端延伸模式,使組織能依據其具體的安全、法規與營運需求,精準配置 AI 基礎架構。

最終成果不僅是導入 AI,更是達成企業級 AI 執行能力,讓靈活性與可擴展性成為基礎的一部分。

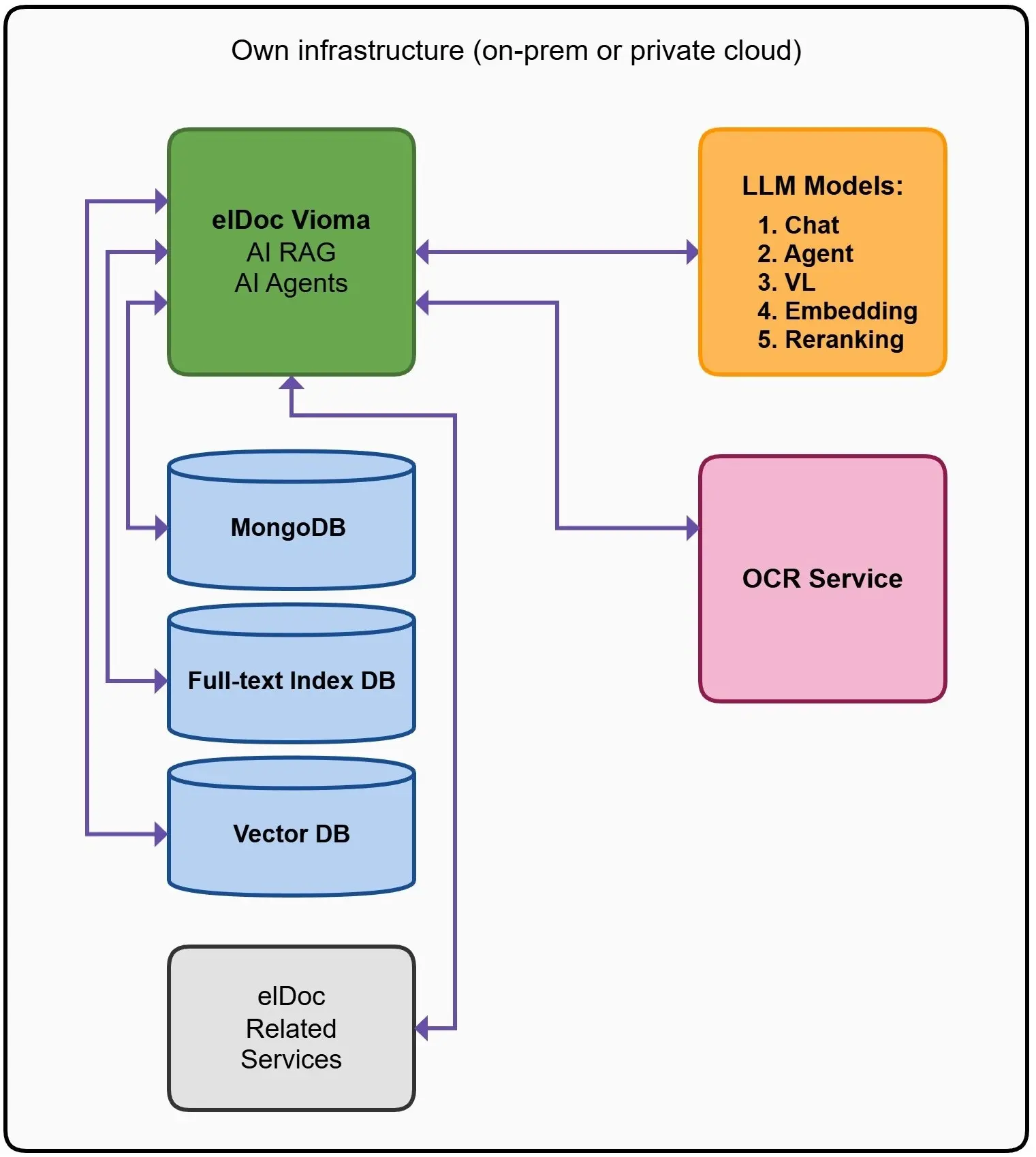

elDoc:完全地端或私有雲部署

最大掌控力,最高安全性

在此部署模式下,整個 AI 生態系統皆在您的自有基礎架構內運行,無論是在地端或完全受控的私有雲環境中。

架構總覽

elDoc,作為核心平台,負責協調 Agentic RAG 與 AI 代理

- MongoDB,儲存結構化資料、文件中繼資料、工作流程狀態與擷取資訊

- 全文索引資料庫,支援在大型文件集合中進行高速關鍵字搜尋

- 向量資料庫,透過嵌入技術實現語意搜尋,使 AI 能理解內容含義,而不僅是字詞

- OCR 服務,將掃描文件與影像型文件轉換為機器可讀文本

- LLM 模型,可在本地部署或透過私有且安全的端點存取

這些元件的實際作用

- MongoDB 作為營運核心骨幹,負責管理所有結構化資訊,包括文件、擷取欄位、稽核日誌與流程狀態,確保整體流程的一致性與可追蹤性。

- 全文搜尋可依據精確詞彙、片語與文件結構進行精準檢索,對於需要嚴格用詞的合規應用場景至關重要,例如合約與法規文件。

- 向量資料庫提供語意理解能力,它並非尋找完全匹配,而是根據內容意義進行檢索,這正是驅動 RAG(檢索增強生成)的核心,使 AI 能跨文件進行推理。

👉 以上各層共同構建出一個混合式檢索系統,結合精準性,關鍵字搜尋,與智慧性,語意搜尋。

這代表什麼

所有資料處理、AI 推理與代理執行皆完全保留在您的環境之內。

- 資料不會離開您的基礎架構

- 不會暴露於公共 AI 服務

- 對每一次互動與決策擁有完全掌控

這不僅是一種部署選擇,更是一種安全架構。

LLM 彈性:無供應商鎖定

在此架構下,elDoc 的一大優勢是模型選擇的完全彈性:

- 使用內部部署的開源模型

- 部署微調後的私有模型

- 整合企業核准的專有模型

- 或依據不同使用情境採用多模型策略

👉 您不會被綁定於任何單一供應商。

這意味著:

- 可依效能、成本或準確性自由優化

- 無需更改架構即可切換模型

- 隨著模型演進而具備未來適應性的 AI 策略

換言之:

您可以自帶模型,或在任何時候自由更換模型。

需要最高控制力的關鍵產業

此部署模式對於資料敏感性、合規性與控制力屬於必要條件的產業尤為關鍵:

金融業

- 銀行、保險、會計

- 符合法規要求

- 保護金融交易與相關記錄

政府與公共部門

- 公民資料與國家系統

- 嚴格的資料主權要求

- 對資訊的司法與法律管控

國防與安全

- 機密與任務關鍵資料

- 氣隙隔離與獨立環境

- 零外部依賴政策

醫療與生命科學

- 病患資料與醫療紀錄

- 符合 GDPR、HIPAA 等相關法規

- 個人與臨床資料高度敏感

製造業與關鍵基礎設施

- 智慧財產,例如設計與規格

- 供應鏈與營運資料

- 工業間諜風險

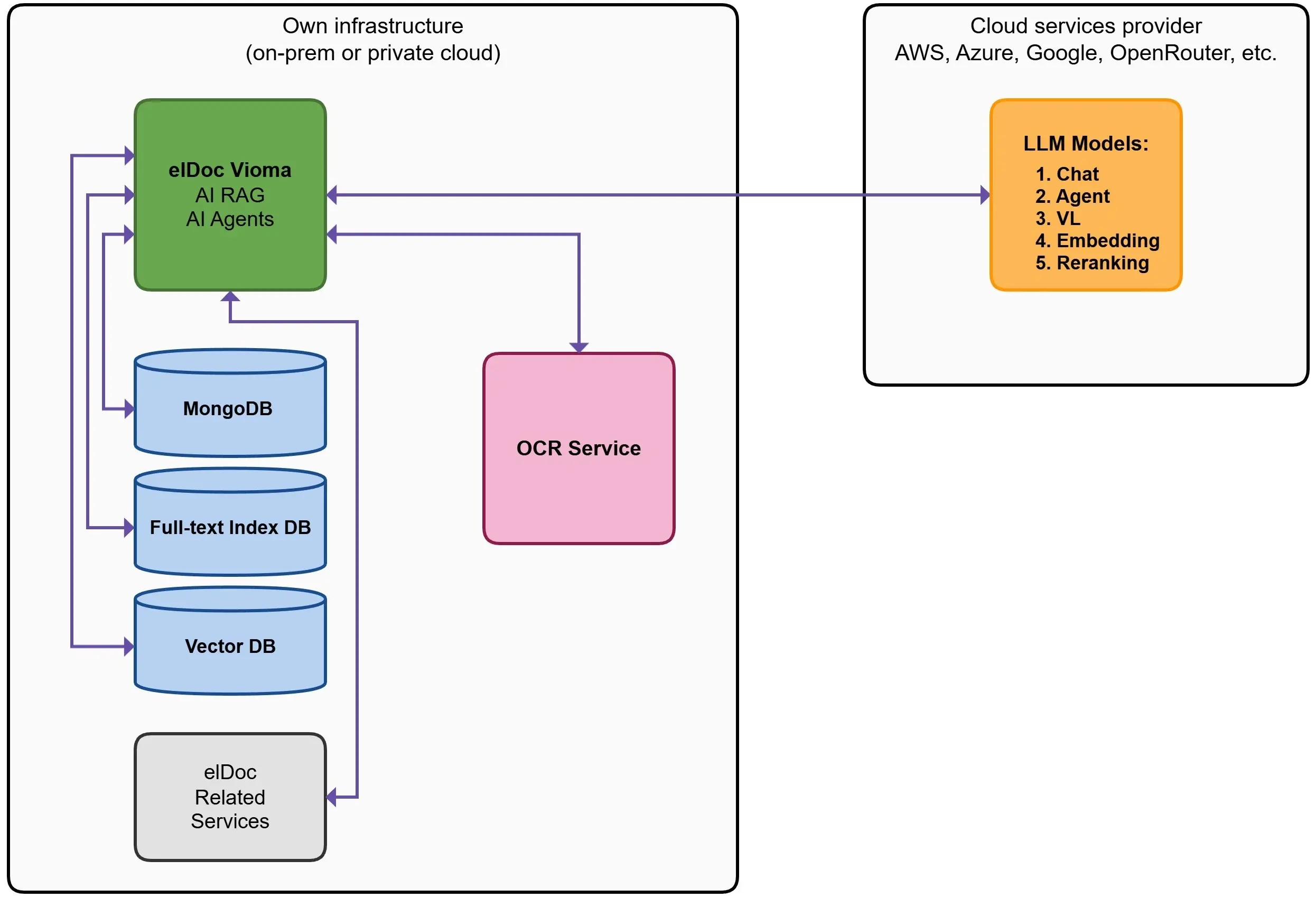

elDoc:混合部署,地端核心加雲端 AI

模型,兼顧控制力與靈活性

這是最常見且最實用的企業部署模式,將地端控制力與雲端 AI 能力相結合。

架構

- elDoc 核心平台運行於地端或私有雲

- 所有資料庫皆保留在內部,包括 MongoDB、全文索引資料庫與向量資料庫

- 外部供應商用於:

- LLM 模型,例如對話、代理、嵌入與重排序

- 以及選用的 AI 服務

這代表什麼

敏感資料、文件與中繼資料皆完全保留在您的環境中進行控制,同時透過安全方式存取外部 LLM 供應商以擴展 AI 能力。在實務上,僅會向模型提供最低必要的上下文,而非完整資料集。

選擇最適合您的 LLM 服務供應商

此架構的一大優勢在於可將 LLM 供應商作為服務來使用,並依據業務需求選擇最適合的模型。企業無需綁定單一供應商或自行建置 AI 基礎設施,即可立即存取 AWS,Bedrock、Azure 或 Google 等服務。

為何這很重要

- 成本效益

無需在 GPU 基礎設施、模型託管或維護上進行大量前期投資,只需按使用量付費 - 降低營運複雜度

基礎設施、擴展與模型更新由供應商負責,使團隊能專注於業務價值,而非 AI 運維 - 使用頂尖模型

可即時運用領先 AI 供應商的最新技術,無需重建架構 - 無鎖定的靈活性

可依效能、價格或特定使用情境輕鬆切換或結合不同供應商

簡而言之,您可避免高額前期投入,同時立即獲得強大且企業級的 AI 能力。

關鍵重點:安全性

即使在此混合架構下,企業級安全仍可全面落實:

- 所有請求皆透過 RBAC、MFA 與存取政策加以保護

- 敏感欄位可完全排除

- 完整的稽核日誌、監控與可追蹤性皆持續維持

👉 AI 的運作完全在您的治理模型之內,而非其外。

何時選擇此部署模式

在以下情況下,此部署模式特別適合:

- 您希望快速導入企業級 AI,而無需大量基礎設施投資

- 您的資料必須維持內部控制

- 您希望透過 AWS Bedrock 或類似服務存取頂尖 LLM 模型

- 您需要在不增加營運複雜度的情況下實現擴展能力

elDoc:適用於所有部署情境的核心層,無論部署於何處,智慧能力始終一致

無論 elDoc 是採用完全地端、混合部署或雲端延伸模式,其核心智慧層皆保持一致。此架構的核心是 elDoc,作為協調引擎,將原始資料轉化為可行動的智慧與自動化執行。

elDoc 所實現的能力

elDoc 不僅是檢索或自動化工具,更是建立於企業資料之上的決策與執行層。

Agentic RAG 協同運作

將檢索、推理與行動整合為單一智慧流程,不再是孤立查詢,而是建立端到端的執行鏈。

跨文件多步推理

跨多個來源分析資訊,連結上下文、驗證關聯性,在產出結果前建立一致且完整的理解。

AI 代理執行

超越單純回應。AI 代理可觸發並執行操作,例如資料擷取、分類或檔案整理,並驗證結果與完成任務,將洞察轉化為實際成果。

具備驗證機制的端到端文件處理

elDoc 支援完整的端到端文件處理流程,從文件導入到最終執行:

- 智慧化文件導入與分類

- AI 驅動的資料擷取

- 內建人機協作機制,用於審核、核准與例外處理

這確保輸出結果不僅自動化,同時具備準確性、可稽核性,並可直接應用於業務。

具備結構化輸出的 AI 資料擷取

透過先進 AI 模型,包含 LLM 與視覺模型,elDoc 可實現:

- 從結構化、非結構化、掃描與影像型文件中進行高精度資料擷取

- 內建 AI OCR 功能,可在處理流程中即時將文件轉換為機器可讀文本

- 無縫處理複雜版面、多格式文件與低品質掃描

處理完成後,資料可立即以結構化格式提供,例如 JSON、CSV,使其能與 ERP 及分析平台等下游系統無縫整合,消除手動輸入,大幅加速處理週期。

跨文件分析與驗證

可識別發票、合約與規格文件之間的不一致、風險與缺口,這是傳統系統難以可靠實現的能力。

企業系統整合

可與 ERP、BPM 及其他企業系統無縫整合,使 AI 能在真實業務流程中運作,而非脫離其外。

無需妥協的企業級 AI:以靈活性為設計核心

在當今企業環境中,AI 的導入無法採用一體適用的方式。各組織面臨不同的監管壓力、基礎架構策略與風險特性,其 AI 平台必須反映這些現實。

elDoc 正是為此挑戰而打造。 作為高度靈活的企業級 AI 與 Agentic RAG 平台,其設計可支援完整的部署需求範圍,無需在安全性、效能或創新之間做出取捨。

在一端,elDoc 可運行於完全隔離的地端或氣隙環境中,資料不會離開組織,且所有流程皆受到嚴格控制,使其特別適用於對安全性、合規性與資料主權有絕對要求的產業。在另一端,它支援混合與雲端延伸架構,使組織能利用最新 AI 發展,例如外部 LLM 供應商,同時仍維持嚴格的企業控制、存取治理與資料保護機制。

elDoc 的差異在於,其靈活性並未犧牲一致性。在所有部署模式下,組織皆可受益於相同的核心智慧層、安全框架與協同運作能力。

最終,這是一個能讓企業實現以下能力的平台:

- 讓 AI 部署符合其安全與合規需求

- 隨時間從受控環境擴展至更靈活的架構

- 避免供應商鎖定並保有對資料與模型的完全掌控

- 在確保 AI 運作於其治理框架內的前提下自信導入 AI

elDoc 確保 AI 不僅強大,更具備可部署性、可控性與可持續性,能支援企業級規模應用。

讓我們聯繫我們

立即了解 elDoc 如何融入您的企業架構,並預約專屬示範

回答您的問題或安排演示以了解我們的解決方案的實際應用:只需給我們留言