RAG completamente offline para chatear con documentos usando elDoc

Durante los últimos dos años, millones de usuarios han experimentado el poder de herramientas como ChatGPT, Gemini y otros asistentes GenAI similares. Son rápidas, intuitivas e impresionantes. Puedes cargar un documento, hacer una pregunta y obtener una respuesta en segundos. Sin embargo, los usuarios con experiencia detectan rápidamente una limitación fundamental:

Estas herramientas procesan tus documentos en la nube, fuera de tu control.

Para un uso ocasional, esto puede ser aceptable. Para cualquier información sensible, no lo es.

El problema oculto de seguridad y cumplimiento en los asistentes GenAI en la nube

Cuando los documentos se cargan en servicios GenAI públicos, dejan de permanecer dentro de tu entorno local. El procesamiento se realiza en infraestructuras de terceros, a menudo distribuidas en múltiples regiones, donde la residencia de los datos, las políticas de retención y los usos secundarios no siempre son completamente transparentes. Los controles de acceso suelen ser genéricos y están pensados para un uso masivo de consumidores, no para una gobernanza de nivel empresarial, lo que deja a los equipos de seguridad y cumplimiento con visibilidad limitada, trazabilidad de auditoría débil y poco control sobre cómo se maneja la información sensible.

Estas brechas generan riesgos significativos al trabajar con registros financieros, contratos legales, documentos de salud y seguros, papeles de trabajo de auditoría y conocimiento corporativo interno. Para las organizaciones que operan bajo marcos regulatorios como el RGPD, normativas financieras u otros estándares de cumplimiento específicos de la industria, esta falta de control suele ser suficiente para impedir por completo la adopción de herramientas GenAI públicas.

El problema de escalabilidad de los asistentes GenAI en la nube del que nadie habla

Otro problema se vuelve inevitable a gran escala: no tiene sentido cargar terabytes de documentos cada vez que se requiere un análisis. La mayoría de las organizaciones ya mantienen grandes repositorios de documentos bien protegidos en recursos compartidos, sistemas de gestión documental, almacenamiento en nubes privadas y archivos on-premise. Enviar repetidamente los mismos datos a servicios de IA externos es ineficiente, costoso, lento e introduce riesgos operativos innecesarios. Un enfoque mucho más práctico es que los documentos permanezcan de forma segura dentro del perímetro de tu organización, se indexen una sola vez mediante IA y luego puedan consultarse de manera inteligente cada vez que se necesiten insights.

Qué significa realmente el “RAG totalmente offline” para el chat con documentos y si de verdad es posible

Cuando las personas escuchan “chat con tus documentos”, a menudo asumen que alguna parte del proceso debe depender de internet o de servicios de IA externos. En realidad, la generación aumentada por recuperación (RAG) totalmente offline no solo es posible, sino que ya es viable en entornos productivos cuando la plataforma está diseñada correctamente.

En esencia, RAG es el patrón arquitectónico que permite a la GenAI trabajar de forma confiable con documentos privados. En lugar de pedir a un modelo de lenguaje que “adivine” respuestas, el sistema primero recupera los fragmentos más relevantes de un repositorio interno de documentos confiables y luego genera una respuesta basada estrictamente en ese contenido recuperado. Esto es lo que hace que el chat con documentos sea preciso, explicable y utilizable en escenarios reales de negocio.

Lo que hace que una solución sea totalmente offline no es la interfaz de chat en sí, sino el hecho de que cada etapa de este flujo se ejecute completamente dentro de tu propia infraestructura, ya sea on-premise o en un entorno de nube privada. Ningún contenido de documentos, metadatos, embeddings, prompts ni respuestas se envía jamás a APIs externas.

Sí, esto es posible, y elDoc está diseñado específicamente para hacerlo práctico.

Cómo elDoc hace realidad el chat con documentos totalmente offline

elDoc es una plataforma GenAI disponible para implementaciones totalmente on-premise, en entornos aislados (air-gapped) o en nubes privadas. Se entrega como un sistema completo y autónomo que incluye todos los componentes necesarios para la comprensión de documentos, la recuperación de información y la interacción conversacional en modo offline.

El proceso comienza con la ingesta y comprensión de documentos. elDoc integra múltiples motores de OCR para gestionar la diversidad y la inconsistencia de los documentos del mundo real. Según los requisitos de implementación, esto incluye OCR de código abierto para extracción general, OCR de alta precisión para diseños complejos, modelos visión-lenguaje con comprensión nativa del layout y OCR multilingüe ultrarrápido para procesamiento a gran escala. Esta flexibilidad permite a las organizaciones equilibrar precisión, velocidad y requisitos estrictos de funcionamiento offline.

Antes de que cualquier modelo de lenguaje analice un documento, elDoc aplica una capa de visión por computadora que limpia, normaliza y optimiza las imágenes documentales. Se corrigen y estructuran escaneos inclinados, bajo contraste, fondos ruidosos, tablas, sellos y firmas, para que los modelos de IA posteriores trabajen con entradas de alta calidad.

Una vez que los documentos están optimizados, los modelos de lenguaje de gran tamaño que se ejecutan localmente proporcionan una comprensión semántica real. Estos modelos no se limitan a extraer texto; interpretan significado, contexto, relaciones e intención a lo largo de párrafos, tablas y secciones. Esto es lo que permite a tus usuarios formular preguntas naturales en lugar de realizar búsquedas por palabras clave.

Chat con tus documentos: del uso privado a la inteligencia a nivel empresarial

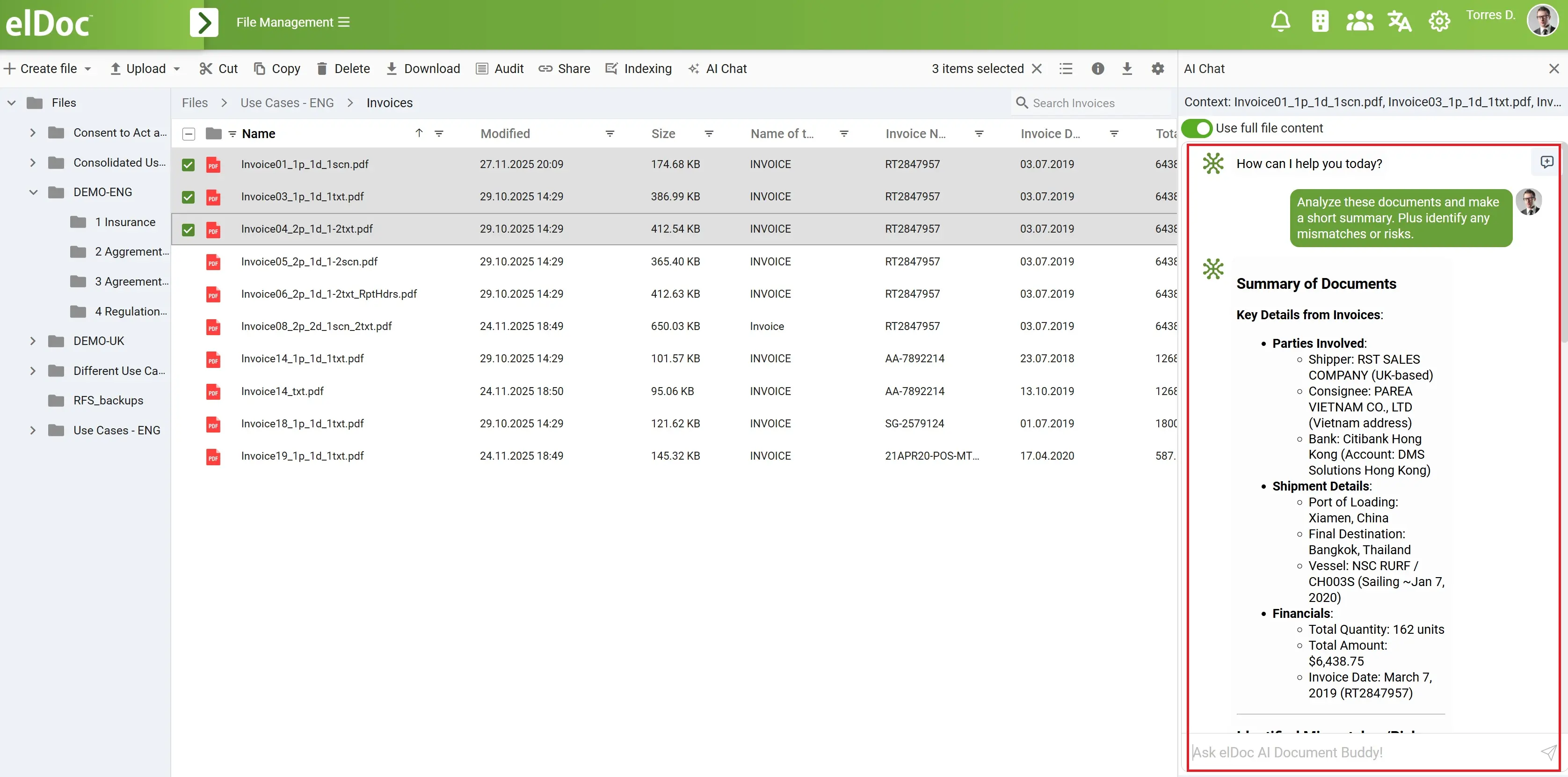

Una vez que elDoc está implementado, los documentos dejan de ser archivos estáticos almacenados en carpetas; se convierten en una base de conocimiento segura e interactiva que los usuarios pueden consultar mediante lenguaje natural. En lugar de abrir archivos uno por uno, buscar manualmente o exportar datos a herramientas externas, los usuarios simplemente chatean con sus documentos en un entorno totalmente offline y regulado.

Para personas particulares, elDoc brinda claridad y confianza al manejar documentos personales altamente sensibles. Los usuarios pueden revisar historiales médicos, pólizas de seguro o contratos legales sin exponer datos privados a plataformas GenAI públicas. Consultas típicas incluyen:

«Por favor analiza mis historiales médicos y resalta cualquier información faltante o inconsistencia que pueda afectar mi tratamiento o cobertura de seguro».

«Según mi póliza de seguro, ¿esta reclamación está cubierta y existen exclusiones o condiciones que deba tener en cuenta?»

En organizaciones pequeñas y medianas, elDoc se convierte en una herramienta diaria de productividad para los equipos de finanzas, operaciones y legales. En lugar de revisar archivos manualmente, los equipos pueden consultar conjuntos completos de documentos a la vez, obteniendo insights instantáneos sobre facturas, contratos y correspondencia. Consultas comunes incluyen:

«En todas las facturas y contratos, identifica pagos vencidos, términos inconsistentes y cualquier discrepancia entre los montos acordados y los facturados».

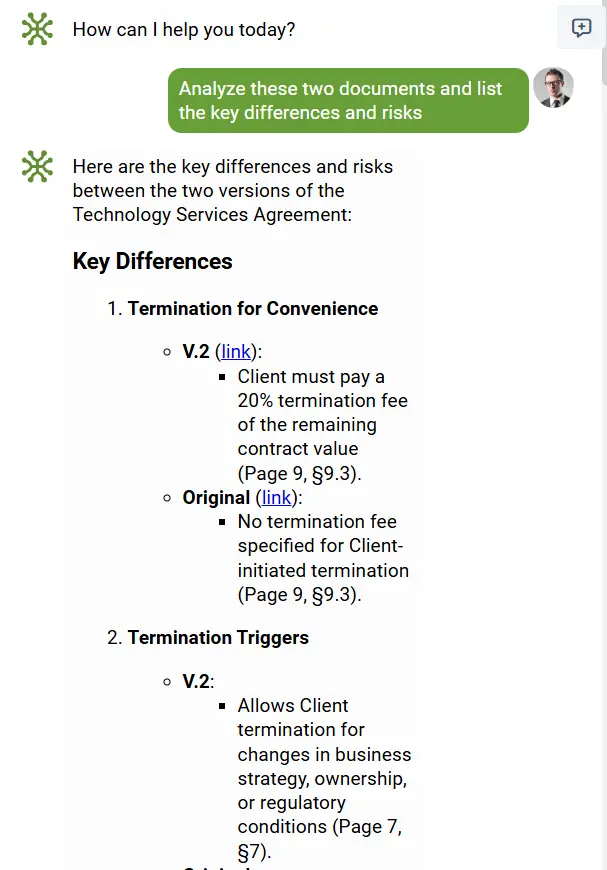

A nivel empresarial, elDoc permite inteligencia documental segura y a gran escala a través de departamentos y regiones, mientras aplica controles de acceso estrictos y trazabilidad de auditoría. Los equipos de finanzas, legales, auditoría y cumplimiento pueden realizar preguntas complejas que cruzan múltiples documentos, que de otro modo requerirían días o semanas de trabajo manual. Consultas típicas incluyen:

«Compara todas las versiones de contratos y marca las cláusulas relacionadas con terminación, responsabilidad y penalidades que se desvíen de nuestra política estándar».

«Revisa nuestros papeles de trabajo de auditoría de los últimos tres años y resalta cambios significativos, anomalías o evidencia de soporte faltante».

En todos los casos de uso, la experiencia se mantiene consistente: los documentos permanecen de forma segura dentro de tu entorno, los permisos se aplican automáticamente y cada respuesta se basa en el contenido real de los documentos aprobados. elDoc ofrece GenAI conversacional para documentos del mundo real, sin comprometer la privacidad, seguridad ni control.

Almacenamiento, recuperación e inteligencia semántica: todo offline

El RAG totalmente offline también requiere capas robustas de almacenamiento y recuperación. elDoc utiliza un repositorio de documentos escalable para gestionar eficientemente tanto archivos grandes como metadatos enriquecidos, asegurando que los documentos permanezcan disponibles, versionados y auditables a lo largo del tiempo. Además, una base de datos vectorial dedicada crea embeddings semánticos localmente, otorgando a los documentos un “significado” que se puede buscar más allá de simples palabras clave. Esto permite que el sistema recupere contenido relevante incluso cuando los usuarios formulan preguntas de manera imprecisa o en lenguaje natural.

Para coincidencias exactas y filtrado de alta velocidad, elDoc combina recuperación semántica con capacidades de búsqueda de texto completo. El resultado es un enfoque híbrido de recuperación que funciona de manera confiable con contratos, facturas, estados financieros, pólizas y documentos escaneados, sin necesidad de salir de tu entorno.

¿Qué tan fácil es desplegar elDoc y comenzar a chatear con tus documentos?

A pesar de la arquitectura sofisticada necesaria para habilitar el chat con documentos totalmente offline —que incluye almacenamiento seguro, motores OCR, visión por computadora, LLMs locales, búsqueda semántica y gobernanza— el despliegue de elDoc es intencionalmente simple. La complejidad está incorporada en la plataforma, no se traslada al usuario ni al equipo de TI.

elDoc se entrega como una solución en contenedor, lo que permite desplegarlo de manera consistente en distintos entornos. Ya seas un usuario individual, un equipo pequeño o una gran empresa, el despliegue sigue el mismo enfoque sencillo: ejecutar el contenedor dentro de tu infraestructura on-premise o en tu entorno de nube privada. No es necesario ensamblar componentes por separado, integrar múltiples proveedores ni gestionar pipelines frágiles; todo lo necesario para chatear con documentos de forma segura viene empaquetado y listo.

Una vez desplegado, empezar es inmediato. Conectas tu modelo de lenguaje preferido según los recursos de hardware disponibles, ya sea solo CPU, aceleración GPU o una configuración híbrida. elDoc es agnóstico al modelo, permitiendo que las organizaciones elijan el LLM que mejor se adapte a sus necesidades de rendimiento, costo y seguridad, manteniendo toda la inferencia completamente local.

Después de esto, los usuarios simplemente cargan documentos o conectan repositorios existentes, inician la indexación y comienzan a chatear. Los documentos nuevos pueden añadirse en cualquier momento y se incorporan automáticamente en consultas futuras sin necesidad de reprocesar los datos existentes. Desde el primer despliegue hasta conversaciones significativas con documentos, elDoc transforma lo que tradicionalmente sería un proyecto complejo de infraestructura GenAI en una configuración práctica, repetible y segura.

En resumen, elDoc hace accesible el chat con documentos totalmente offline y de nivel empresarial, sin sacrificar control, flexibilidad ni facilidad de despliegue.

elDoc Community Edition: RAG local para tus documentos

Para hacer que la inteligencia documental totalmente offline sea accesible más allá de las grandes empresas, elDoc también está disponible como Community Edition. Esta versión está diseñada para usuarios individuales, desarrolladores y pequeños equipos que deseen ejecutar chat con documentos basado en RAG de manera local —en una laptop, estación de trabajo o pequeño servidor— sin enviar los documentos a la nube.

La Community Edition ofrece las capacidades esenciales necesarias para chatear con documentos de forma segura. Los usuarios pueden cargar archivos, indexarlos localmente y hacer preguntas en lenguaje natural sobre su colección de documentos. Todo el procesamiento ocurre en la máquina local o dentro del entorno privado del usuario, garantizando plena privacidad y control de los datos. No hay dependencia de servicios de IA externos, lo que la hace ideal para experimentar con GenAI en documentos sensibles.

A pesar de ser ligera, la Community Edition sigue los mismos principios arquitectónicos que la plataforma empresarial. Los documentos se procesan mediante OCR y visión por computadora, se indexan en un repositorio semántico local y se consultan a través de un pipeline RAG respaldado por un modelo de lenguaje que se ejecuta localmente. Los usuarios simplemente conectan un LLM compatible con los recursos de hardware disponibles —CPU o GPU— y comienzan a chatear.

elDoc Community Edition es perfecta para:

- Pequeños equipos que quieran ejecutarla de forma local

- Probar flujos de trabajo de chat con documentos antes de implementarla en la empresa

- Usuarios preocupados por la privacidad que deseen asistencia de IA sin exponer datos a la nube

Con elDoc Community Edition, el chat potente con documentos ya no se limita a implementaciones empresariales complejas. Ofrece inteligencia segura, local y potenciada por RAG a cualquiera que desee trabajar con documentos de manera privada y eficiente.

Qué incluye elDoc Community Edition: la pila completa de IA local

El Community Edition de elDoc no es una demo simplificada. Se entrega como una plataforma RAG local totalmente funcional que incluye toda la canalización de IA necesaria para extraer, comprender, buscar y chatear con documentos, ejecutándose completamente en tu propia máquina o entorno local.

Aunque la arquitectura subyacente es sofisticada, todos los componentes están preintegrados y orquestados para ti. El resultado es una experiencia fluida: carga documentos, indexa una sola vez y comienza a hacer preguntas sin plantillas, configuraciones manuales ni dependencias de la nube.

A continuación se muestra la pila completa incluida en elDoc Community Edition.

OCR — convirtiendo imágenes y PDFs en texto

La mayoría de los documentos, especialmente las facturas, llegan como escaneos, imágenes o PDFs no buscables. El OCR es el primer paso crítico que transforma estos archivos en texto legible por máquina para que la IA pueda comprenderlos realmente.

En la Community Edition, elDoc incluye motores OCR con capacidad offline, tales como:

- Tesseract OCR — OCR de código abierto para extracción de texto general

- PaddleOCR — OCR multilingüe ultrarrápido optimizado para layouts y formatos diversos

- Qwen3-VL — OCR visión-lenguaje con comprensión de layout incorporada para documentos complejos

Estos motores permiten una extracción de texto precisa de documentos ruidosos, de baja calidad o multilingües, manteniendo todo el procesamiento local.

Visión por computadora — limpieza y normalización de documentos

Antes de que la salida del OCR se envíe a los modelos de IA, elDoc aplica una capa de preprocesamiento de visión por computadora. Este paso mejora drásticamente la precisión y la confiabilidad.

La capa de Visión por Computadora realiza enderezado y alineación de páginas rotadas, eliminación de ruido y mejora de contraste, y normalización del layout. Al estandarizar documentos reales desordenados, elDoc asegura que los modelos de IA posteriores trabajen con entradas limpias y estructuradas, uno de los factores más críticos para un RAG exitoso.

LLM — verdadera comprensión del contenido

En el núcleo de elDoc Community Edition se encuentra un Modelo de Lenguaje de Gran Tamaño (LLM) ejecutándose localmente. Este modelo actúa como motor de razonamiento que comprende los documentos como lo haría un humano, pero de manera más rápida y consistente.

El LLM interpreta significado, contexto e intención en textos no estructurados, tablas y secciones. Extrae campos clave como totales, fechas, impuestos, proveedores y partidas, clasifica documentos sin plantillas y detecta inconsistencias o anomalías. Esto permite consultas en lenguaje natural en lugar de reglas rígidas o búsquedas por palabras clave.

Los usuarios simplemente conectan el LLM que se ajuste a sus recursos de hardware disponibles —CPU o GPU— y elDoc se encarga del resto.

RAG — conectando el contexto entre documentos

La Generación Aumentada por Recuperación (RAG) es lo que convierte documentos individuales en una base de conocimiento conectada. En elDoc Community Edition, RAG permite que el sistema recupere fragmentos relevantes de múltiples documentos y los utilice como contexto fundamentado para respuestas generadas por IA. Esto permite a los usuarios validar datos entre archivos, detectar inconsistencias y realizar preguntas complejas que abarcan varios documentos, como comparar facturas, verificar alineación con contratos o resumir tendencias en un conjunto de datos.

RAG garantiza que las respuestas siempre se basen en el contenido real de los documentos, y no en suposiciones o “alucinaciones”.

MongoDB — almacenamiento escalable de documentos

MongoDB funciona como el repositorio principal de documentos y metadatos en elDoc. Gestiona eficientemente archivos grandes y resultados de extracción estructurados, incluso cuando las estructuras de los documentos varían ampliamente. Su esquema flexible, recuperación rápida y confiabilidad lo hacen ideal para flujos de trabajo de inteligencia documental local, formando la columna vertebral de la capa de datos estructurados de elDoc.

Qdrant — inteligencia semántica y búsqueda vectorial

Qdrant proporciona comprensión semántica mediante embeddings vectoriales generados localmente. Permite que elDoc encuentre significado más allá de palabras clave, detectando documentos similares, duplicados y relaciones entre archivos. Esta capa semántica es esencial para recuperación inteligente, agrupamiento de documentos y respuestas precisas basadas en RAG.

Apache Solr — búsqueda de texto completo de alta velocidad

Apache Solr complementa la búsqueda semántica con indexación de palabras clave de nivel empresarial. Permite búsqueda de texto completo instantánea, filtrado, clasificación y navegación a través de grandes conjuntos de documentos.

Juntos, Solr y Qdrant forman un motor de búsqueda híbrido: precisión por palabras clave combinada con comprensión semántica y razonamiento de IA.

Estación de validación — puntuación, confianza y gestión de excepciones

Más allá de la extracción, elDoc incluye una Estación de Validación que evalúa la calidad y confiabilidad de los resultados de IA.

Esta capa asigna puntuaciones de confianza a los campos extraídos, señala datos con baja confianza o conflictivos e identifica excepciones que requieren revisión humana. Las reglas de validación se pueden aplicar a través de los documentos para detectar campos faltantes, valores inconsistentes, incumplimientos de umbral o discrepancias entre archivos relacionados (por ejemplo, facturas vs. contratos o pólizas). La Estación de Validación permite un flujo de trabajo con supervisión humana, asegurando que los resultados de la IA sean transparentes, auditables y listos para producción, en lugar de tratarse como resultados de “caja negra”.

Marco de seguridad robusto — roles, permisos y gobernanza

La seguridad está incorporada en elDoc desde sus cimientos, incluso en la Community Edition. La plataforma incluye un marco de control de acceso basado en roles (RBAC) que define roles y responsabilidades claros para usuarios y equipos. Los permisos se pueden aplicar a nivel de espacio de trabajo, carpeta, documento y función, incluyendo el acceso a funciones de GenAI como indexación, chat, exportación y compartición de archivos.

elDoc soporta autenticación multifactor (MFA) para acceso seguro y puede integrarse con proveedores de identidad empresariales, incluyendo Active Directory (AD) o sistemas de autenticación basados en directorios. Esto asegura una gestión de identidad consistente, control centralizado de usuarios y alineación con las políticas de seguridad existentes.

Todas las acciones se registran, creando una trazabilidad clara de acceso a documentos, interacciones con IA y decisiones de validación, crucial para cumplimiento, gobernanza y confianza.

Además de seguridad y gobernanza, elDoc soporta despliegues de alta disponibilidad. Gracias a su arquitectura en contenedores, elDoc puede desplegarse en configuraciones en clúster o replicadas para eliminar puntos únicos de falla. Esto permite a las organizaciones asegurar acceso continuo a la inteligencia documental, escalar cargas de trabajo entre nodos y mantener resiliencia operativa incluso durante mantenimiento o interrupciones de infraestructura.

En conjunto, estas capacidades hacen que elDoc sea adecuado no solo para experimentación, sino también para inteligencia documental segura, confiable y siempre disponible, desde usuarios individuales hasta despliegues empresariales críticos.

Ponte en contacto con nosotros

Obtén tu versión gratuita de elDoc Community y despliega tu LLM preferido de forma local

Resuelve tus dudas o programa una demostración para ver nuestra solución en acción – solo envíanos un mensaje